TED日本語

TED Talks(英語 日本語字幕付き動画)

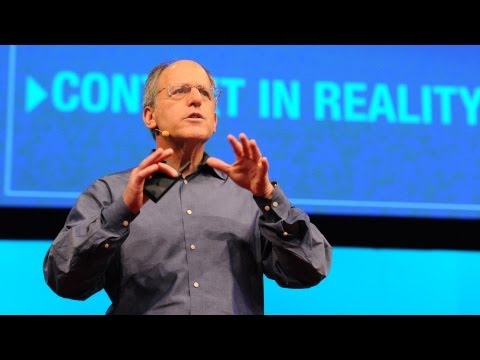

TED日本語 - エド・ウルブリッチ: ベンジャミン・バトンの顔はこうしてできた

TED Talks

ベンジャミン・バトンの顔はこうしてできた

How Benjamin Button got his face

エド・ウルブリッチ

Ed Ulbrich

内容

デジタルエフェクト界のカリスマ、デジタル・ドメインのエド・ウルブリッチが視覚効果部門でオスカー賞を獲得した映画「ベンジャミン・バトン 数奇な人生」について、いかにブラッド・ピットの若い顔から年をとった顔までがCGで作り上げられたかを話します。

字幕

SCRIPT

Script

I'm here today representing a team of artists and technologists and filmmakers that worked together on a remarkable film project for the last four years. And along the way they created a breakthrough in computer visualization.

So I want to show you a clip of the film now. Hopefully it won't stutter. And if we did our jobs well, you won't know that we were even involved.

Voice (Video): I don't know how it's possible ... but you seem to have more hair.

Brad Pitt: What if I told you that I wasn't getting older ... but I was getting younger than everybody else?

I was born with some form of disease.

BP: I was born old.

Man: I'm sorry.

BP: No need to be. There's nothing wrong with old age.

Girl: Are you sick?

BP: I heard momma and Tizzy whisper, and they said I was gonna die soon. But ... maybe not.

Girl: You're different than anybody I've ever met.

BB: There were many changes ... some you could see, some you couldn't. Hair started growing in all sorts of places, along with other things. I felt pretty good, considering.

Ed Ulbrich: That was a clip from "The Curious Case of Benjamin Button." Many of you, maybe you've seen it or you've heard of the story, but what you might not know is that for nearly the first hour of the film, the main character, Benjamin Button, who's played by Brad Pitt, is completely computer-generated from the neck up. Now, there's no use of prosthetic makeup or photography of Brad superimposed over another actor's body. We've created a completely digital human head.

So I'd like to start with a little bit of history on the project. This is based on an F. Scott Fitzgerald short story. It's about a man who's born old and lives his life in reverse. Now, this movie has floated around Hollywood for well over half a century, and we first got involved with the project in the early '90s, with Ron Howard as the director. We took a lot of meetings and we seriously considered it. But at the time we had to throw in the towel. It was deemed impossible. It was beyond the technology of the day to depict a man aging backwards. The human form, in particular the human head, has been considered the Holy Grail of our industry.

The project came back to us about a decade later, and this time with a director named David Fincher. Now, Fincher is an interesting guy. David is fearless of technology, and he is absolutely tenacious. And David won't take "no." And David believed, like we do in the visual effects industry, that anything is possible as long as you have enough time, resources and, of course, money. And so David had an interesting take on the film, and he threw a challenge at us. He wanted the main character of the film to be played from the cradle to the grave by one actor. It happened to be this guy.

We went through a process of elimination and a process of discovery with David, and we ruled out, of course, swapping actors. That was one idea: that we would have different actors, and we would hand off from actor to actor.

We even ruled out the idea of using makeup. We realized that prosthetic makeup just wouldn't hold up, particularly in close-up. And makeup is an additive process. You have to build the face up. And David wanted to carve deeply into Brad's face to bring the aging to this character. He needed to be a very sympathetic character. So we decided to cast a series of little people that would play the different bodies of Benjamin at the different increments of his life and that we would in fact create a computer-generated version of Brad's head, aged to appear as Benjamin, and attach that to the body of the real actor. Sounded great.

Of course, this was the Holy Grail of our industry, and the fact that this guy is a global icon didn't help either, because I'm sure if any of you ever stand in line at the grocery store, you know -- we see his face constantly. So there really was no tolerable margin of error. There were two studios involved: Warner Brothers and Paramount. And they both believed this would make an amazing film, of course, but it was a very high-risk proposition. There was lots of money and reputations at stake. But we believed that we had a very solid methodology that might work ...

But despite our verbal assurances, they wanted some proof. And so, in 2004, they commissioned us to do a screen test of Benjamin. And we did it in about five weeks. But we used lots of cheats and shortcuts. We basically put something together to get through the meeting. I'll roll that for you now. This was the first test for Benjamin Button. And in here, you can see, that's a computer-generated head -- pretty good -- attached to the body of an actor. And it worked. And it gave the studio great relief. After many years of starts and stops on this project, and making that tough decision, they finally decided to greenlight the movie. And I can remember, actually, when I got the phone call to congratulate us, to say the movie was a go, I actually threw up. (Laughter) You know, this is some tough stuff.

So we started to have early team meetings, and we got everybody together, and it was really more like therapy in the beginning, convincing each other and reassuring each other that we could actually undertake this. We had to hold up an hour of a movie with a character. And it's not a special effects film; it has to be a man. We really felt like we were in a -- kind of a 12-step program. And of course, the first step is: admit you've got a problem. (Laughter) So we had a big problem: we didn't know how we were going to do this. But we did know one thing. Being from the visual effects industry, we, with David, believed that we now had enough time, enough resources, and, God, we hoped we had enough money. And we had enough passion to will the processes and technology into existence.

So, when you're faced with something like that, of course you've got to break it down. You take the big problem and you break it down into smaller pieces and you start to attack that. So we had three main areas that we had to focus on. We needed to make Brad look a lot older -- needed to age him 45 years or so. And we also needed to make sure that we could take Brad's idiosyncrasies, his little tics, the little subtleties that make him who he is and have that translate through our process so that it appears in Benjamin on the screen.

And we also needed to create a character that could hold up under, really, all conditions. He needed to be able to walk in broad daylight, at nighttime, under candlelight, he had to hold an extreme close-up, he had to deliver dialogue, he had to be able to run, he had to be able to sweat, he had to be able to take a bath, to cry, he even had to throw up. Not all at the same time -- but he had to, you know, do all of those things.

And the work had to hold up for almost the first hour of the movie. We did about 325 shots. So we needed a system that would allow Benjamin to do everything a human being can do. And we realized that there was a giant chasm between the state of the art of technology in 2004 and where we needed it to be.

So we focused on motion capture. I'm sure many of you have seen motion capture. The state of the art at the time was something called marker-based motion capture. I'll give you an example here. It's basically the idea of, you wear a leotard, and they put some reflective markers on your body, and instead of using cameras, there're infrared sensors around a volume, and those infrared sensors track the three-dimensional position of those markers in real time. And then animators can take the data of the motion of those markers and apply them to a computer-generated character. You can see the computer characters on the right are having the same complex motion as the dancers.

But we also looked at numbers of other films at the time that were using facial marker tracking, and that's the idea of putting markers on the human face and doing the same process. And as you can see, it gives you a pretty crappy performance. That's not terribly compelling. And what we realized was that what we needed was the information that was going on between the markers. We needed the subtleties of the skin. We needed to see skin moving over muscle moving over bone. We needed creases and dimples and wrinkles and all of those things.

Our first revelation was to completely abort and walk away from the technology of the day, the status quo, the state of the art. So we aborted using motion capture. And we were now well out of our comfort zone, and in uncharted territory. So we were left with this idea that we ended up calling "technology stew." We started to look out in other fields. The idea was that we were going to find nuggets or gems of technology that come from other industries like medical imaging, the video game space, and re-appropriate them. And we had to create kind of a sauce. And the sauce was code in software that we'd written to allow these disparate pieces of technology to come together and work as one.

Initially, we came across some remarkable research done by a gentleman named Dr. Paul Ekman in the early '70s. He believed that he could, in fact, catalog the human face. And he came up with this idea of Facial Action Coding System, or FACS. He believed that there were 70 basic poses or shapes of the human face, and that those basic poses or shapes of the face can be combined to create infinite possibilities of everything the human face is capable of doing. And of course, these transcend age, race, culture, gender. So this became the foundation of our research as we went forward.

And then we came across some remarkable technology called Contour. And here you can see a subject having phosphorus makeup stippled on her face. And now what we're looking at is really creating a surface capture as opposed to a marker capture. The subject stands in front of a computer array of cameras, and those cameras can, frame-by-frame, reconstruct the geometry of exactly what the subject's doing at the moment. So, effectively, you get 3D data in real time of the subject. And if you look in a comparison, on the left, we see what volumetric data gives us and on the right you see what markers give us. So, clearly, we were in a substantially better place for this. But these were the early days of this technology, and it wasn't really proven yet. We measure complexity and fidelity of data in terms of polygonal count. And so, on the left, we were seeing 100,000 polygons. We could go up into the millions of polygons. It seemed to be infinite.

This was when we had our "Aha!" This was the breakthrough. This is when we're like, "OK, we're going to be OK, This is actually going to work." And the "Aha!" was, what if we could take Brad Pitt, and we could put Brad in this device, and use this Contour process, and we could stipple on this phosphorescent makeup and put him under the black lights, and we could, in fact, scan him in real time performing Ekman's FACS poses. Right? So, effectively, we ended up with a 3D database of everything Brad Pitt's face is capable of doing. (Laughter)

From there, we actually carved up those faces into smaller pieces and components of his face. So we ended up with literally thousands and thousands and thousands of shapes, a complete database of all possibilities that his face is capable of doing.

Now, that's great, except we had him at age 44. We need to put another 40 years on him at this point. We brought in Rick Baker, and Rick is one of the great makeup and special effects gurus of our industry. And we also brought in a gentleman named Kazu Tsuji, and Kazu Tsuji is one of the great photorealist sculptors of our time. And we commissioned them to make a maquette, or a bust, of Benjamin. So, in the spirit of "The Great Unveiling" -- I had to do this -- I had to unveil something. So this is Ben 80. We created three of these: there's Ben 80, there's Ben 70, there's Ben 60. And this really became the template for moving forward.

Now, this was made from a life cast of Brad. So, in fact, anatomically, it is correct. The eyes, the jaw, the teeth: everything is in perfect alignment with what the real guy has. We have these maquettes scanned into the computer at very high resolution -- enormous polygonal count. And so now we had three age increments of Benjamin in the computer.

But we needed to get a database of him doing more than that. We went through this process, then, called retargeting. This is Brad doing one of the Ekman FACS poses. And here's the resulting data that comes from that, the model that comes from that. Retargeting is the process of transposing that data onto another model. And because the life cast, or the bust -- the maquette -- of Benjamin was made from Brad, we could transpose the data of Brad at 44 onto Brad at 87. So now, we had a 3D database of everything Brad Pitt's face can do at age 87, in his 70s and in his 60s.

Next we had to go into the shooting process. So while all that's going on, we're down in New Orleans and locations around the world. And we shot our body actors, and we shot them wearing blue hoods. So these are the gentleman who played Benjamin. And the blue hoods helped us with two things: one, we could easily erase their heads; and we also put tracking markers on their heads so we could recreate the camera motion and the lens optics from the set.

But now we needed to get Brad's performance to drive our virtual Benjamin. And so we edited the footage that was shot on location with the rest of the cast and the body actors and about six months later we brought Brad onto a sound stage in Los Angeles and he watched on the screen. His job, then, was to become Benjamin. And so we looped the scenes. He watched again and again. We encouraged him to improvise. And he took Benjamin into interesting and unusual places that we didn't think he was going to go. We shot him with four HD cameras so we'd get multiple views of him and then David would choose the take of Brad being Benjamin that he thought best matched the footage with the rest of the cast.

From there we went into a process called image analysis. And so here, you can see again, the chosen take. And you are seeing, now, that data being transposed on to Ben 87. And so, what's interesting about this is we used something called image analysis, which is taking timings from different components of Benjamin's face. And so we could choose, say, his left eyebrow. And the software would tell us that, well, in frame 14 the left eyebrow begins to move from here to here, and it concludes moving in frame 32. And so we could choose numbers of positions on the face to pull that data from.

And then, the sauce I talked about with our technology stew -- that secret sauce was, effectively, software that allowed us to match the performance footage of Brad in live action with our database of aged Benjamin, the FACS shapes that we had. On a frame-by-frame basis, we could actually reconstruct a 3D head that exactly matched the performance of Brad.

So this was how the finished shot appeared in the film. And here you can see the body actor. And then this is what we called the "dead head," no reference to Jerry Garcia.

And then here's the reconstructed performance now with the timings of the performance. And then, again, the final shot. It was a long process. (Applause)

The next section here, I'm going to just blast through this, because we could do a whole TEDTalk on the next several slides.

We had to create a lighting system. So really, a big part of our processes was creating a lighting environment for every single location that Benjamin had to appear so that we could put Ben's head into any scene and it would exactly match the lighting that's on the other actors in the real world.

We also had to create an eye system. We found the old adage, you know, "The eyes are the window to the soul," absolutely true. So the key here was to keep everybody looking in Ben's eyes. And if you could feel the warmth, and feel the humanity, and feel his intent coming through the eyes, then we would succeed. So we had one person focused on the eye system for almost two full years.

We also had to create a mouth system. We worked from dental molds of Brad. We had to age the teeth over time.

We also had to create an articulating tongue that allowed him to enunciate his words. There was a whole system written in software to articulate the tongue. We had one person devoted to the tongue for about nine months. He was very popular.

Skin displacement: another big deal. The skin had to be absolutely accurate. He's also in an old age home, he's in a nursing home around other old people, so he had to look exactly the same as the others. So, lots of work on skin deformation, you can see in some of these cases it works, in some cases it looks bad. This is a very, very, very early test in our process. So, effectively we created a digital puppet that Brad Pitt could operate with his own face. There were no animators necessary to come in and interpret behavior or enhance his performance.

There was something that we encountered, though, that we ended up calling "the digital Botox effect." So, as things went through this process, Fincher would always say, "It sandblasts the edges off of the performance." And thing our process and the technology couldn't do, is they couldn't understand intent, the intent of the actor. So it sees a smile as a smile. It doesn't recognize an ironic smile, or a happy smile, or a frustrated smile. So it did take humans to kind of push it one way or another.

But we ended up calling the entire process and all the technology "emotion capture," as opposed to just motion capture. Take another look.

Brad Pitt: Well, I heard momma and Tizzy whisper, and they said I was gonna die soon, but ... maybe not.

EU: That's how to create a digital human in 18 minutes. (Applause)

A couple of quick factoids; it really took 155 people over two years, and we didn't even talk about 60 hairstyles and an all-digital haircut. But, that is Benjamin. Thank you.

今日私は 4年間のすばらしい映画製作プロジェクトに共に関わった アーティスト 技術者 映画製作者のチームの代表としてここに来ています この過程でコンピュータ ビジュアリゼーションは大きく進歩しました

これから映画のクリップをお見せします きちんと映像が流れるといいのですが 仕事が成功していたら 私たちの存在は気づかれないはずです

映像:どうしてかしら ― 前より髪が増えてるわ

ベンジャミン バトン:年を取るごとに ― 若返っていく僕をみんなはどう思う?

持病を持って生まれたんだ ―

声:どんな病気で?

ベンジャミン:老人の体で生まれた

男:お気の毒に

ベンジャミン:年を取るのは悪いことじゃない

少女:病気なの?

ベンジャミン:ママとティズィーは ― 数年の命と言っていたけど ― たぶん違う

少女:あなたは他の誰とも違うわ

ベンジャミン:多くの変化が訪れた 目に見えるものと 目に見えないもの 色んな場所に毛が生え始めたり ― 他にも変化はあった 気分がよかった

エド:「ベンジャミン バトン 数奇な人生」からの映像でした 映画を見られた方も ストーリーを耳にした方も ― 知らないことがあるとすれば 映画の最初 ほぼ1時間にわたって ブラッド ピットが演じる主人公のベンジャミン バトンの ― 首から上は完全にCGだということです 特殊メイクは使っていませんし ― 他の俳優の体にブラッドのイメージを合成したものでもありません 完全なるCGの顔を作りあげました

まずはこのプロジェクトの歴史を少しお話したいと思います F スコット フィッツジェラルドの短編小説をもとにした ― 老人として生まれ 成長するにしたがって若返っていく男の話です この映画はハリウッド中をぐるぐると 50年以上もさまよっていました 私たちが最初にこのプロジェクトに参加したのは90年代初頭で ロン ハワードが監督でした 何度も会議を開き映画化を真剣に考えました しかし当時は諦めなければなりませんでした 不可能だとみなされたのです 年を取るにつれて若返る男を描くのは当時の技術では無理でした 人間の体は ― 特に頭部ですが ― 私たちの業界では神の領域とされていました

10年ほど経ってからプロジェクトが再始動しました 今回の監督はデイビット フィンチャーです 彼は面白い人です 技術に対して恐怖心というものがないのです またプロジェクトに強い執着がありました 「ノー」は存在しなかったのです デイビットはビジュアルエフェクト業界の人間と同じように ― 十分な時間と資源 ― そしてもちろんお金がある限り 全ては可能だと信じていました 彼は面白い取り組み方をして ― 私たちにある挑戦をさせることにしました 映画の主人公を ゆりかごから墓場まで ― 一人の俳優で撮影すると言い出したのです 主人公は彼になりました

私たちはデイビットと共にあれでもないこれでもないと考え抜き 当然 映画の途中で俳優を入れ替える案は除外されました 何人かの俳優を使うのはひとつの手でした シーン別に違う俳優がベンジャミンを演じるのです

特殊メイクを施すアイデアも除外しました メイクでは不十分だということが分かったのです 特にクローズアップでは無理です それにメイクは付加的なプロセスで 顔を作り上げるのとは違います デイビットは年を重ねたしわを表現するのに ブラッドの顔の奥深くまで切り込んでいきたかったのです ベンジャミンは多くの共感を呼ぶ人物でなければなりません そこで年を経るにつれて変わる ― ベンジャミンの体のサイズに合わせ ― 背の低い役者を段階的に割り当てることにしました それから実際にベンジャミンと年相応の ― ブラッドの頭部をCGで作り上げ 本物の俳優の首の上に乗せるのです 良い計画だと思いました

もちろんこれは私たちの業界における聖域であり ― 世界に名の知れた俳優を使うことで 難しさは増しました 誰もがスーパーで見かける雑誌などを通して 毎日のように彼の顔を見ているのですから 少しのずれもミスも許されないのです 映画会社はワーナー ブラザーズとパラマウントが関わりました 両スタジオはこの映画にもちろん期待してくれたのですが この映画はかなりリスクの高い計画でした 多くの資金と名誉が問われていました 私たちは 自分たちの方法論はとても堅実でうまくいくだろう ― と信じていましたが ―

彼らは口約束以外に ― できるという保証を欲しがりました ですから2004年にベンジャミンのスクリーンテストをすることになりました 5週間ほどにわたって行われたのですが ― たくさんのズルや近道をしました テストを切り抜けるために断片をつなぎ合わせたにすぎませんでした 少しお見せします こちらが最初のベンジャミンのテスト映像です CGの頭がお見えですね かなりの精度です 他の俳優の首の上にのせました テストは成功し スタジオを安心させることができました 何年間も前進と後退を続け ― 困難な決断を下しながら ついにスタジオからゴーサインが出ました 実際に電話で祝賀をいただいたときのことを覚えています 映画に許可が下りたと聞いて 思わず吐きました (笑い) 計画は困難なものであったので

チームミーティングを行うことにしました 全員参加です 最初のうちは会議というよりセラピーに近いものでした この映画は実際に現実のものとなる とお互いを励まし説得しました 映画全体の内1時間はCGのベンジャミンが主演です しかもSFX映画ではないので 本物の人間らしくなければなりませんでした そのプロセスは ある意味では 依存症克服プログラムのようで ― 最初の一歩は当然「問題の存在を認めること」 大きな問題でした どうやって取り組めばいいのかも分からなかったのですから けれどひとつだけ分かっていることがありました VFX業界で働く者として ― 私たち それからデイビットは時間も資源も豊富だと分かっていました 資金が足りることだけを願いました プロジェクトを実現させるための熱意も十分にありました

このような問題に直面したら ― まず問題を細かく砕いてから考えます 大きな問題をいくつかの小さな問題に分けるのです それから一つ一つに取り組みます 私たちはこれを3つに分けました まずブラッドに今の年齢よりも 45歳くらい年を取らせなければなりませんでした またブラッドの特徴を取り入れることも必要でした 顔の小さな痙攣や機微のすべてが彼を彼たらしめているので ― 全ての過程でそれらを取り入れ スクリーンのベンジャミンに反影させる必要がありました

それからベンジャミンは あらゆる状況に対応できるキャラクターでなければなりませんでした 真っ昼間だけでなく 夜 キャンドルの光の下を歩いたり クローズアップにも耐えられ もちろん台詞も話せて 走ったり汗をかいたり お風呂に入ったり泣いたり 吐くことすらできなくてはなりませんでした もちろん全て同時にではありませんが これら全てをこなせる必要がありました

そしてそれらで映画のはじめ1時間を作らなければならなかったので およそ325パターンの撮影をしました 私たちにはベンジャミンに ― 人間ができる全てのことをさせる必要があったのですが 2004年当時の最先端技術と 私たちの要する技術との間には 深い淵があることに気づきました

そこでモーションキャプチャーに注目しました モーションキャプチャーはご存知ですね 当時の最先端技術では マーカーベース モーションキャプチャーと言われていました こちらが例です 簡単に説明すると レオタードを着て 動きを捕らえるマーカーを装着します カメラの代わりに 赤外線センサーが周囲に置かれ それらのセンサーがマーカーの動きを3次元かつ リアルタイムでトラックします それからアニメーターはマーカーの動きのデータを CGの俳優に写していきます 右側のコンピュータ上のキャラクターが ダンサーと同じ複雑な動きをしていますね

さらに私たちは 顔にマーカーをつけて ― モーションキャプチャーを顔に適応している 当時の映画をいくつか見て プロセスを研究しました 見てわかる通り とても雑な出来栄えです 完成にはほど遠いものでした そこでわかったのは 私たちには ― マーカーとマーカーの間にある情報が必要だということです 皮膚の細かい情報が欠けていました 皮膚が筋肉や骨の上を動く様子や えくぼ 大きなしわから小さなしわまで全ての情報が必要でした

私たちの最初の発見は 当時の最先端技術も手法も 完全に捨て去らなくてはならない ということでした モーションキャプチャーも諦め 頼れるものは何一つなくなり ― 未開の地に踏み込むこととなりました 残されたアイデアは 私たちが「テクノロジー シチュー」と呼ぶものです 他のフィールドを研究して 技術の原石を見つけるというのが このアイデアです 医学画像やテレビゲームなどの 優れた他業界の技術を ― 見つけだし 再適応させるのです コンピュータのプログラムの中に コード情報を書き込んでいって それぞれ異なる技術の断片を組み合わせて ひとつの技術として動かすのです

初めてすぐに 70年代にポール エクマンという学者によってなされた すばらしい研究に遭遇しました 彼は実際に人間の表情を ― 分類できると考え FACS ― 顔動作記述システム ― を作り出しました このシステムによると人間の顔は 基本的に70の型からできていて それらの顔のポーズや形を組み合わせて 人間の顔ができる 無限の表情を作り出すことができるというわけです しかも年齢や人種 文化やジェンダーを問わないシステムでした これが私たちの研究のベースになりました

それから私たちはコンターと呼ばれる 驚くべき技術に出会いました 被験者が発光性のメイクを ― 顔に施されているのがお見えですね ここでは マーカーから得る情報とは逆に 表面の情報を捕らえています 被験者はカメラが並んだコンピュータの前に立つと カメラがフレームごとに 被験者がとっているのと全く同じ顔の表情を復元していきます 効果的にリアルタイムで被験者の3Dデータがとれるのです 比べて見てみると 左側がデータ数が増えたもの 右側がマーカーデータのものです 見ての通り かなり見通しが良くなりました しかしこの技術は当時まだ生みだされて間もなく 確実性はありませんでした けれど私たちはポリゴンの観点から 複雑かつ信憑性のあるデータ測定をしました 左側では10万ものポリゴンが見えました そしてそれを100万まで増やすことに成功し その数は無限に近づいていきました

歓喜が沸いたのはこのときでした これが突破口となったからです 「これで何とかなる 実際に成功するだろう」 と初めて考えた瞬間でした その歓喜は被験者をブラッド ピットに置き換え この装置を彼の顔につけることにつながりました このコンターを使って 彼に発光性のメイクを施し 不可視光線の下に立ってもらって 実際に彼がエクマンのFACSシステムになぞって 表情を作るのをリアルタイムで読み取りました 実際に ― ブラッド ピットの顔が表現できる 全ての表情の3Dデータベースができあがりました (笑い)

そこからは実際にもっと細かい要素にまで ― 切り込んでいって 文字通り何千という型ができあがりました 彼の顔が表現できる表情 全てのデータベースが出来上がりました

彼が44歳であるという事以外は完璧でした 次は現在の彼の年齢に40年を加算する作業です 私たちはリック ベーカーに連絡しました 彼は私たちの業界では特殊メイクや特殊効果の ― 巨匠といわれています またカズヒロ ツジにも依頼をしました 彼はフォトリアリスティック彫刻の最高峰です 彼らにベンジャミンの上半身の模型作りを ― 依頼しました それでは今年の会議テーマ「素晴らしい除幕」にちなんで ベールをとると ― こちらが80歳のベンジャミンです 模型は3つ作りました 80歳 70歳それから60歳のベンジャミンです これらが私たちが前進する基盤となりました

ブラッドの型どりから作り上げた実物大なので 解剖学的にも正しいデータです 目やあご 歯にいたるまで ― 全てが1対1で本物のブラッドと対応しています 私たちはこれら3つの模型を高解像度で コンピュータに取り込みました 莫大なポリゴン数です そうしてコンピュータ上に3段階の年齢の ― ベンジャミンが生まれました

今度はそのデータ上の彼に動きを加えるため リターゲティングと呼ばれるプロセスに移りました こちらがブラッドがエクマンのFACSの表情をしているところです それから得られるデータがこちらです モデル上のデータですね そしてリターゲティングとはこのデータを 他のモデルに転置することです ベンジャミンの上半身の模型は ブラッドの実物大なので 44歳のブラッドのデータを87歳のブラッドに 転置することができるのです ブラッド ピットの顔の動き全ての3Dデータが 87歳それから70代 60代の彼に転置されました

次は撮影の段階に入ります これまでの過程と同時並行で ニューオリンズを始めとする世界中のロケ地で撮影は進められました ベンジャミンの体を演じる役者は 青いフード帽をかぶって撮影に入ります こちらがその役者の方です 青いフード帽には2つの役割があります 彼らの頭部を消す処理が簡単にできることと 動きを捉えるマーカーをつけることで カメラの動きやレンズの焦点を 再現できることです

ベンジャミンのモデルはブラッドの演技を反影して動かすので ロケ地で他の出演者やベンジャミンの体の役者を撮影した ― フィルムの編集に入りました そして約6ヶ月後 ロサンゼルスの同録スタジオにブラッドを呼びました 彼はスクリーンを見て ベンジャミンを演じます 彼は映画のシーンを 繰り返し何度も見ました 即興の演技をお願いすると ブラッドは私たちが予想だにしなかった 興味深いベンジャミンを演じてくれました 撮影はいくつかのアングルからとらえるため 4台のHDカメラで行いました ブラッドが演じたベンジャミンの中から 今度はデイビットが ― 場面や他の出演者と最もよく合うものを 選んでいきました

そこからは画像解析という過程に入ります こちらでは選ばれたテイクがお見えですね データが87歳のベンジャミンに転置されています ここでおもしろいのは ベンジャミンの顔の それぞれのパーツが動くタイミングをはかる画像解析です 例えばベンジャミンの左の眉毛を選ぶと コンピュータプログラムが フレーム14では眉毛はここからここまで動き ― フレーム32で止まるという事を教えてくれます このようにしていくつもの顔の動きを選んで データを引き出していくのです

それからテクノロジーシチューでお話しした技術を使います 鍵となる技術は 効果的に ― ブラッドの動作そのものを FACSシステムに基づく データベース上の ― 年を取ったベンジャミンに移すこと これを使って私たちはフレームごとに ブラッドの演技と全く同じ動きをする3Dの頭部を 再現することができました

こちらが完成したフィルムの映像です そしてこちらが体を演じる俳優の演技 これが ― ジェリー ガルシアではありませんが ― 未完成の「デットヘッド」

そして今度は実際の演技のタイミングから 再現したものです そしてもう一度完成した映像です ここまで来るのには時間がかかりました (拍手)

次の数枚のスライドだけでも ひとつのTEDトークになるほど お話できるのですが ここからは概要だけお話します

今度は照明効果を完成させなければなりませんでした この工程で重要なのはベンジャミンが現れる全ての場面に適した ― 照明を作り上げることでした ベンジャミンの頭部は様々な場面に出てくるので ロケ地で他の俳優が演技をしている照明と 完璧に合うものにしなければなりません

それから目に特化したシステムも作り出しました 「目は口ほどにものを言う」という あの古いことわざは 嘘ではありません ここでのゴールは 多くの人にベンジャミンの目だけを見てもらって 温かさや優しさ それから彼の意図するところが 目を通して伝わることです ですから目の動きを担当した技術者は ほぼ丸2年間目の研究に明け暮れました

それから口に特化したシステムも必要でした ブラッドの歯の型をベースにして 時と共に歯にも変化を加えました

それから言葉をしっかり発音するための舌も必要でした 発話時の舌の動き全てを記録したシステムも作りました 舌の動きだけに約9ヶ月専念してくれた人がいて 彼は人気者でした

もうひとつ重要なのが皮膚の動き ベンジャミンは老人ホームや 特別養護施設など 他の老人たちと演技をするシーンがあるので 彼らと全く同じように見えるため 皮膚の動きは正確でなければなりません ですから皮膚の動きには多くの労力を費やしました 自然に見えるものもあれば 不自然なものもあるでしょう 今お見せしているのはこの過程の初期段階のものです 私たちはデジタル人形を作って ブラッドにその顔を操ってもらいました 行動を解析したり演技を高めたりするアニメーターは 必要ありませんでした

ただ ひとつこれらの過程で対処できないことがありました 「CGによるボトックス注射」というものです これらのプロセス通してフィンチャーがいつも言っていたのは 「デジタル処理で俳優の演技の見せ場が色あせてしまう」ということです 私たちのプロセスと技術ができなかったのは 意図を理解するということです 俳優の意図することの理解です 笑顔は笑顔でしかないわけで その笑顔が意味するのは皮肉なのか嬉しさなのか落胆なのか 判断できないのです ですからここは人間がある意味機械の道しるべをする必要がありました

けれど最終的にこのプロセスと技術は 「エモーション キャプチャー」と呼ばれるまで発達しました モーションキャプチャーと対になるものです もうひとつ映像を見てください

ブラッド ピット:ママとティズィーは ― 数年の命と言っていたけど たぶん違う

18分の「デジタル人間をつくる方法」でした (拍手)

短い説明でしたが 実際には155人が2年以上もこの過程に携わりました 60ものヘアスタイルとコンピュータ上でのヘアカットのお話はできませんでしたが これがベンジャミンです ありがとうございました

品詞分類

- 主語

- 動詞

- 助動詞

- 準動詞

- 関係詞等

TED 日本語

TED Talks

関連動画

ピクサー映画に命を吹き込む魔法の成分ダニエル・フェインバーグ

2016.04.28

多様で美しい、ムスリムとしての生き方バサーム・タリク

2015.01.30

世界に潜む音楽の儀式ヴィンセント・ムーン、ナナ・ヴァスコンセロス

2014.11.14

「スパイダーマン」「ライオン・キング」とその創作にかけた人生ジュリー・テイモア

2013.07.31

私が不可能な映画を製作した方法についてマーティン・ヴィルヌーブ

2013.06.07

視覚効果から見る映画史ドン・レヴィ

2013.01.04

迫真の映像の作り方ロブ・レガート

2012.08.17

映画の素晴らしさを共有するビーバン・キドロン

2012.06.13

我々は自らが語る物語であるシェーカル・カプール

2010.04.01

「アバター」を生み出した好奇心ジェームス・キャメロン

おすすめ 62010.03.04

ドキュメンタリー映画「マイ・アーキテクト」を語るナサニエル・カーン

2009.04.06

洋楽 おすすめ

RECOMMENDS

洋楽歌詞

ステイザ・キッド・ラロイ、ジャスティン・ビーバー

洋楽最新ヒット2021.08.20

スピーチレス~心の声ナオミ・スコット

洋楽最新ヒット2019.05.23

シェイプ・オブ・ユーエド・シーラン

洋楽人気動画2017.01.30

フェイデッドアラン・ウォーカー

洋楽人気動画2015.12.03

ウェイティング・フォー・ラヴアヴィーチー

洋楽人気動画2015.06.26

シー・ユー・アゲインウィズ・カリファ

洋楽人気動画2015.04.06

シュガーマルーン5

洋楽人気動画2015.01.14

シェイク・イット・オフテイラー・スウィフト

ポップス2014.08.18

オール・アバウト・ザット・ベースメーガン・トレイナー

ポップス2014.06.11

ストーリー・オブ・マイ・ライフワン・ダイレクション

洋楽人気動画2013.11.03

コール・ミー・メイビーカーリー・レイ・ジェプセン

洋楽人気動画2012.03.01

美しき生命コールドプレイ

洋楽人気動画2008.08.04

バッド・デイ~ついてない日の応援歌ダニエル・パウター

洋楽人気動画2008.05.14

サウザンド・マイルズヴァネッサ・カールトン

洋楽人気動画2008.02.19

イッツ・マイ・ライフボン・ジョヴィ

ロック2007.10.11

アイ・ウォント・イット・ザット・ウェイバックストリート・ボーイズ

洋楽人気動画2007.09.14

マイ・ハート・ウィル・ゴー・オンセリーヌ・ディオン

洋楽人気動画2007.07.12

ヒーローマライア・キャリー

洋楽人気動画2007.03.21

オールウェイズ・ラヴ・ユーホイットニー・ヒューストン

洋楽人気動画2007.02.19

オネスティビリー・ジョエル

洋楽人気動画2005.09.16