TED日本語

TED Talks(英語 日本語字幕付き動画)

TED日本語 - モーリス・コンティ: 直感を持った人工知能が生み出すすごい発明

TED Talks

直感を持った人工知能が生み出すすごい発明

The incredible inventions of intuitive AI

モーリス・コンティ

Maurice Conti

内容

デザインツールにデジタル神経系を与えたら何ができるでしょう?コンピューターが我々の思考力や想像力を高め、ロボットシステムが橋や車やドローンなどの画期的な新しいデザインを自分で考え出し、構築するのです。未来学者のモーリス・コンティといっしょに「拡張の時代」へと旅し、人にもロボットにも単独では作り得ないようなものが共同で作り上げられる世界を垣間見てみましょう。

字幕

SCRIPT

Script

How many of you are creatives, designers, engineers, entrepreneurs, artists, or maybe you just have a really big imagination? Show of hands? (Cheers)

That's most of you. I have some news for us creatives. Over the course of the next 20 years, more will change around the way we do our work than has happened in the last 2,000. In fact, I think we're at the dawn of a new age in human history.

Now, there have been four major historical eras defined by the way we work. The Hunter-Gatherer Age lasted several million years. And then the Agricultural Age lasted several thousand years. The Industrial Age lasted a couple of centuries. And now the Information Age has lasted just a few decades. And now today, we're on the cusp of our next great era as a species.

Welcome to the Augmented Age. In this new era, your natural human capabilities are going to be augmented by computational systems that help you think, robotic systems that help you make, and a digital nervous system that connects you to the world far beyond your natural senses. Let's start with cognitive augmentation. How many of you are augmented cyborgs?

(Laughter)

I would actually argue that we're already augmented. Imagine you're at a party, and somebody asks you a question that you don't know the answer to. If you have one of these, in a few seconds, you can know the answer. But this is just a primitive beginning. Even Siri is just a passive tool. In fact, for the last three-and-a-half million years, the tools that we've had have been completely passive. They do exactly what we tell them and nothing more. Our very first tool only cut where we struck it. The chisel only carves where the artist points it. And even our most advanced tools do nothing without our explicit direction. In fact, to date, and this is something that frustrates me, we've always been limited by this need to manually push our wills into our tools -- like, manual, literally using our hands, even with computers. But I'm more like Scotty in "Star Trek."

(Laughter)

I want to have a conversation with a computer. I want to say, "Computer, let's design a car," and the computer shows me a car. And I say, "No, more fast-looking, and less German," and bang, the computer shows me an option.

(Laughter)

That conversation might be a little ways off, probably less than many of us think, but right now, we're working on it. Tools are making this leap from being passive to being generative. Generative design tools use a computer and algorithms to synthesize geometry to come up with new designs all by themselves. All it needs are your goals and your constraints.

I'll give you an example. In the case of this aerial drone chassis, all you would need to do is tell it something like, it has four propellers, you want it to be as lightweight as possible, and you need it to be aerodynamically efficient. Then what the computer does is it explores the entire solution space: every single possibility that solves and meets your criteria -- millions of them. It takes big computers to do this. But it comes back to us with designs that we, by ourselves, never could've imagined. And the computer's coming up with this stuff all by itself -- no one ever drew anything, and it started completely from scratch. And by the way, it's no accident that the drone body looks just like the pelvis of a flying squirrel.

(Laughter)

It's because the algorithms are designed to work the same way evolution does.

What's exciting is we're starting to see this technology out in the real world. We've been working with Airbus for a couple of years on this concept plane for the future. It's a ways out still. But just recently we used a generative-design AI to come up with this. This is a 3D-printed cabin partition that's been designed by a computer. It's stronger than the original yet half the weight, and it will be flying in the Airbus A320 later this year. So computers can now generate; they can come up with their own solutions to our well-defined problems. But they're not intuitive. They still have to start from scratch every single time, and that's because they never learn. Unlike Maggie.

(Laughter)

Maggie's actually smarter than our most advanced design tools. What do I mean by that? If her owner picks up that leash, Maggie knows with a fair degree of certainty it's time to go for a walk. And how did she learn? Well, every time the owner picked up the leash, they went for a walk. And Maggie did three things: she had to pay attention, she had to remember what happened and she had to retain and create a pattern in her mind.

Interestingly, that's exactly what computer scientists have been trying to get AIs to do for the last 60 or so years. Back in 1952, they built this computer that could play Tic-Tac-Toe. Big deal. Then 45 years later, in 1997, Deep Blue beats Kasparov at chess. 2011, Watson beats these two humans at Jeopardy, which is much harder for a computer to play than chess is. In fact, rather than working from predefined recipes, Watson had to use reasoning to overcome his human opponents. And then a couple of weeks ago, DeepMind's AlphaGo beats the world's best human at Go, which is the most difficult game that we have. In fact, in Go, there are more possible moves than there are atoms in the universe. So in order to win, what AlphaGo had to do was develop intuition. And in fact, at some points, AlphaGo's programmers didn't understand why AlphaGo was doing what it was doing.

And things are moving really fast. I mean, consider -- in the space of a human lifetime, computers have gone from a child's game to what's recognized as the pinnacle of strategic thought. What's basically happening is computers are going from being like Spock to being a lot more like Kirk.

(Laughter)

Right? From pure logic to intuition. Would you cross this bridge? Most of you are saying, "Oh, hell no!"

(Laughter)

And you arrived at that decision in a split second. You just sort of knew that bridge was unsafe. And that's exactly the kind of intuition that our deep-learning systems are starting to develop right now. Very soon, you'll literally be able to show something you've made, you've designed, to a computer, and it will look at it and say, "Sorry, homie, that'll never work. You have to try again." Or you could ask it if people are going to like your next song, or your next flavor of ice cream. Or, much more importantly, you could work with a computer to solve a problem that we've never faced before. For instance, climate change. We're not doing a very good job on our own, we could certainly use all the help we can get. That's what I'm talking about, technology amplifying our cognitive abilities so we can imagine and design things that were simply out of our reach as plain old un-augmented humans.

So what about making all of this crazy new stuff that we're going to invent and design? I think the era of human augmentation is as much about the physical world as it is about the virtual, intellectual realm. How will technology augment us? In the physical world, robotic systems. OK, there's certainly a fear that robots are going to take jobs away from humans, and that is true in certain sectors. But I'm much more interested in this idea that humans and robots working together are going to augment each other, and start to inhabit a new space.

This is our applied research lab in San Francisco, where one of our areas of focus is advanced robotics, specifically, human-robot collaboration. And this is Bishop,one of our robots. As an experiment, we set it up to help a person working in construction doing repetitive tasks -- tasks like cutting out holes for outlets or light switches in drywall.

(Laughter)

So, Bishop's human partner can tell what to do in plain English and with simple gestures, kind of like talking to a dog, and then Bishop executes on those instructions with perfect precision. We're using the human for what the human is good at: awareness, perception and decision making. And we're using the robot for what it's good at: precision and repetitiveness.

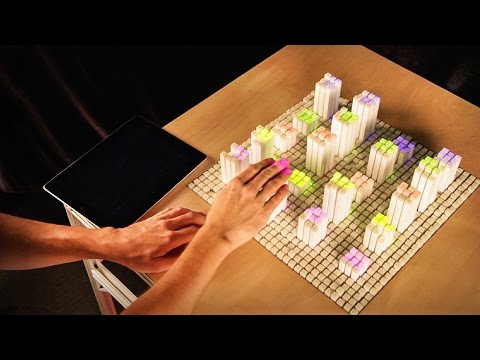

Here's another cool project that Bishop worked on. The goal of this project, which we called the HIVE, was to prototype the experience of humans, computers and robots all working together to solve a highly complex design problem. The humans acted as labor. They cruised around the construction site, they manipulated the bamboo -- which, by the way, because it's a non-isomorphic material, is super hard for robots to deal with. But then the robots did this fiber winding, which was almost impossible for a human to do. And then we had an AI that was controlling everything. It was telling the humans what to do, telling the robots what to do and keeping track of thousands of individual components. What's interesting is, building this pavilion was simply not possible without human, robot and AI augmenting each other.

OK, I'll share one more project. This one's a little bit crazy. We're working with Amsterdam-based artist Joris Laarman and his team at MX3D to generatively design and robotically print the world's first autonomously manufactured bridge. So, Joris and an AI are designing this thing right now, as we speak, in Amsterdam. And when they're done, we're going to hit "Go," and robots will start 3D printing in stainless steel, and then they're going to keep printing, without human intervention, until the bridge is finished.

So, as computers are going to augment our ability to imagine and design new stuff, robotic systems are going to help us build and make things that we've never been able to make before. But what about our ability to sense and control these things? What about a nervous system for the things that we make?

Our nervous system, the human nervous system, tells us everything that's going on around us. But the nervous system of the things we make is rudimentary at best. For instance, a car doesn't tell the city's public works department that it just hit a pothole at the corner of Broadway and Morrison. A building doesn't tell its designers whether or not the people inside like being there, and the toy manufacturer doesn't know if a toy is actually being played with -- how and where and whether or not it's any fun. Look, I'm sure that the designers imagined this lifestyle for Barbie when they designed her.

(Laughter)

But what if it turns out that Barbie's actually really lonely?

(Laughter)

If the designers had known what was really happening in the real world with their designs -- the road, the building, Barbie -- they could've used that knowledge to create an experience that was better for the user. What's missing is a nervous system connecting us to all of the things that we design, make and use. What if all of you had that kind of information flowing to you from the things you create in the real world? With all of the stuff we make, we spend a tremendous amount of money and energy -- in fact, last year, about two trillion dollars -- convincing people to buy the things we've made. But if you had this connection to the things that you design and create after they're out in the real world, after they've been sold or launched or whatever, we could actually change that, and go from making people want our stuff, to just making stuff that people want in the first place.

The good news is, we're working on digital nervous systems that connect us to the things we design. We're working on one project with a couple of guys down in Los Angeles called the Bandito Brothers and their team. And one of the things these guys do is build insane cars that do absolutely insane things. These guys are crazy --

(Laughter)

in the best way. And what we're doing with them is taking a traditional race-car chassis and giving it a nervous system.

So we instrumented it with dozens of sensors, put a world-class driver behind the wheel, took it out to the desert and drove the hell out of it for a week. And the car's nervous system captured everything that was happening to the car. We captured four billion data points; all of the forces that it was subjected to. And then we did something crazy. We took all of that data, and plugged it into a generative-design AI we call "Dreamcatcher." So what do get when you give a design tool a nervous system, and you ask it to build you the ultimate car chassis? You get this. This is something that a human could never have designed. Except a human did design this, but it was a human that was augmented by a generative-design AI, a digital nervous system and robots that can actually fabricate something like this.

So if this is the future, the Augmented Age, and we're going to be augmented cognitively, physically and perceptually, what will that look like? What is this wonderland going to be like?

I think we're going to see a world where we're moving from things that are fabricated to things that are farmed. Where we're moving from things that are constructed to that which is grown. We're going to move from being isolated to being connected. And we'll move away from extraction to embrace aggregation. I also think we'll shift from craving obedience from our things to valuing autonomy.

Thanks to our augmented capabilities, our world is going to change dramatically. We're going to have a world with more variety, more connectedness, more dynamism, more complexity, more adaptability and, of course, more beauty. The shape of things to come will be unlike anything we've ever seen before. Why? Because what will be shaping those things is this new partnership between technology, nature and humanity. That, to me, is a future well worth looking forward to.

Thank you all so much.

(Applause)

この中で創造的なことを している人 ― デザイナー エンジニア 起業家 アーティスト あるいは単に想像力が豊かという人は どれくらいいますか? 手を挙げてください (歓声)

ほとんどがそうですね そういう人に お知らせすることがあります これからの20年で 私たちの仕事の仕方は これまでの2千年間における変化よりも 大きく変わるでしょう 私たちは人類史の新時代に 差し掛かっていると思います

人類史には 仕事の仕方に応じて 大きく4つの時代がありました 狩猟採集時代が 数百万年続き それから数千年の 農耕時代があり 2百年ほどの 工業化時代があり 現在の情報化時代が ほんの数十年です そして今 私たちは人類にとって 新しく大きな時代の始まりにいます

「拡張の時代」へようこそ この新時代においては 人間の自然な能力が 拡張されることになるでしょう 計算システムが 人間の思考を補助し ロボットシステムが 作業を助け デジタル神経系が 生来の感覚を大きく越えて 私たちを世界へと繋げます 認識力拡張の話から 始めましょう 強化サイボーグだという方は どれくらい いらっしゃいますか?

(笑)

私たちは既に増強されていると 言えると思います パーティで誰かに 知らないことを聞かれたところを 想像してください こういうものを持っていれば 数秒で答えが分かります でもこれはまだ原始的な 始まりでしかありません あのSiriでさえ ただの受け身のツールです 実際 過去350万年の間 人類の道具はずっと 完全に受け身のものでした 指示した通りのことだけをし それ以上のことはしません 人類最初の道具は 打ち付けた場所を切るだけでした のみは彫刻家が指定したところを 削るだけです 最も先進的なツールでさえ 明示的な指示なしには何もしません これは私がよくフラストレーションを 感じることですが 道具にこちらの意向を 指示する必要によって 我々は制限されてきました コンピューターがあっても 文字通り手を使って 指示する必要があります しかし私はスタートレックの スコッティみたいな人間です

(笑)

コンピューターと 会話がしたいんです 「コンピューター 車をデザインしよう」 と言ったら コンピューターが 車を出して見せます 「もっと速そうな感じで ドイツっぽくなくしてくれ」と言うと コンピューターが注文通りにしてくれるんです

(笑)

この会話は まだ先の話ですが 皆さんが考えるほど 遠くはなく 私たちは既に 取り組んでいます 道具は受け身のものから 生成するものへと飛躍しつつあります デザイン生成ツールは コンピューターとアルゴリズムを使って 形状を合成し 自分で新しいデザインを 作り出します 必要なのは 目標と制約だけです

例をお見せしましょう これはドローン用の フレームの例ですが こちらがするのは 必要なことを伝えるだけ 4つのプロペラがあるとか 出来るだけ軽くとか 空力的な効率を良くしろとか すると与えられた条件を満たす あらゆる可能な解の全体 ― 何百万通りという解を コンピューターが探索します これには大型のコンピューターが 必要になりますが 私たち自身が 考えも付かないような デザインが生まれます コンピューターは 自分だけで答えを出します 誰かが何か 描いてやることはなく 何もないところから 始めるのです ちなみに このドローンの フレームが ムササビの骨盤に似ているのは 偶然ではありません

(笑)

このアルゴリズムは 進化と同じように働くよう デザインされているからです

この技術を世の中で 実際に目にするようになって ワクワクしています この2年 オートデスク社は エアバス社と協力して 未来の飛行機のコンセプトモデルに 取り組んできました まだ先は長いですが デザイン生成AIを使って 最近こんなものを 作り出しました これは3D印刷された客室の隔壁ですが コンピューターがデザインしたものです 元の半分の重量で より高い強度を持ち 年内にエアバスA320で 使われ始める予定です 明確に定義された問題に対して コンピューターは今や 自力で独自の解を生み出せるんです しかし直感的とは言えません 毎回 1から始める 必要があります 学習しないからです うちの犬のマギーとは違います

(笑)

マギーは実際 最先端のデザインツールよりも 賢いんです どういう意味かというと 飼い主がリードを 手にしていたら それはかなりの確率で 散歩を意味すると マギーは理解しています どうやってそう学んだのでしょう? 飼い主がリードを手に取るたびに 散歩に出たからです そこでマギーは 3つのことをしていました 注意を払うこと 何が起きたか 覚えていること 心の中にパターンを作って 保持することです

興味深いことに これはまさにコンピューター科学者達が 過去60年の間 人工知能にさせようと 試み続けてきたことです 1952年に 三目並べができる コンピューターが作られました 大したことでした 45年後の1997年 ディープブルーはチェス王者 カスパロフを破りました 2011年 ワトソンはクイズ番組ジェパディで 歴代チャンピオン2人に勝ちました これはコンピューターには チェスよりも ずっと難しいことです 定められた手順に 従ってやる代わりに ワトソンは人間の対戦相手に勝つために 推論をする必要がありました そして2週間前 ディープマインド社のAlphaGoが 最も難しいゲームとされる碁で 世界最強の碁指しを 破りました 碁には宇宙の原子の 総数よりも 多くの手があります 勝つためにAlphaGoは 直感力を発達させる 必要がありました 実際AlphaGoが なぜそうしたのか 開発者自身にも 分からないことがありました

物事はとても 速く進んでいます 人の一生の時間のうちに コンピューターにできることが 子供の遊びから 最高度の戦略的思考にまで 進歩したのです ここで起きているのは スポックのようだった コンピューターが カークみたいになった ということです

(笑)

純粋な論理から 直感へという変化です みなさん この橋を渡ろうと思いますか? 多くの人は 「まさか!」と言うでしょう

(笑)

コンマ何秒で そういう判断をするのです この橋は安全でないと 知っていたかのようです 今やディープラーニングシステムが そのような直感を 獲得しつつあります 近い将来 皆さんは 自分の作ったものや デザインしたものを コンピューターに見せて 意見してもらえるようになるでしょう 「相棒 こりゃ駄目だよ やり直しだね」 あるいは「みんなこの歌を 気に入ってくれるだろうか?」とか 「この新しい味のアイスは受けるか?」とか 聞けるでしょう さらに重要なのは これまで直面したことのない問題に コンピューターで 取り組めるようになることです たとえば気候変動です 人類はあまり上手く 対処できていないので どんな助けでも ありがたいことでしょう それが私の お話ししていることです テクノロジーが人間の 認知能力を増強し 拡張されていない素の人間には 単に手の届かなかったものを 思い描き デザインできるように なるということです

では我々が発明しデザインしようとしている そういう新しいクレージーなものは どうやって製造するのか? 人類拡張の時代は 仮想的・知的な領域だけでなく 物質的世界にも 関わるものです テクノロジーはいかに人間を拡張するのか? 物質的世界では ロボットシステムによってです 人間の仕事が ロボットに奪われる怖れは 確かにあって ある種の領域では 実際そうなるでしょう でも私がもっと興味があるのは 一緒に働く人間とロボットが 互いを拡張し合って 新しい領域を切り開く というアイデアです

これはサンフランシスコにある 我々の応用技術研究所です その主要な研究領域の1つが 先進ロボット工学 ― 特に人間とロボットの 共同作業です これは我々のロボットBishopです 繰り返し作業のある建築現場で 作業者を手伝うよう 実験的に セットアップしてあります 壁にコンセントや電灯スイッチのための 穴を開けるといった作業です

(笑)

人間のパートナーが 単純な言葉やシンプルな手振りで やることを示します 犬に話かけるみたいに Bishopは指示されたことを 完璧な正確さで実行します 人間には 人間の得意なことを してもらいます 認識とか 知覚とか 意志決定です ロボットには ロボットの得意な ことをさせます 精密な反復作業です

これはBishopがやった 別の面白いプロジェクトです このHIVEという名の プロジェクトでは 人間と コンピューターと ロボットが共同して 非常に複雑な設計問題を解決するという 体験を試行しています 人間は労働者として働きます 建築現場を動き回り 竹素材を扱います ちなみに形状の異なる竹は ロボットには扱うのが 非常に難しい素材です ロボットはこのファイバーを 張る作業をします 人間にはほとんど 不可能なことです そして人工知能が 全体の制御をしています 人間とロボットに それぞれの作業を指示し 何千という要素を管理します これが興味深いのは このパビリオンの構築は 人間とロボットと人工知能が 補い合って 取り組まねば 不可能だったということです

もう1つプロジェクトをご紹介しましょう ちょっとクレージーなものです アムステルダムを中心に活動する ヨリス・ラーマンとMX3Dのチームとともに 世界初の自律的に建設する橋を デザイン生成と ロボットによる3D印刷で 作ろうというものです 今まさにアムステルダムで ヨリスと人工知能が 橋をデザインしています デザインが完成し 実行を指示すると ロボットがステンレスで橋を 3D印刷し始めます そして橋が出来るまで 人の手助けなしに 自律的に印刷を続けます

コンピューターが 新しいものを想像しデザインする 人間の能力を拡張し ロボットシステムが 以前には作り得なかったものを 製造・建設する手助けをしてくれます そういったものを感じ制御する 能力についてはどうでしょう? 我々の作る物の神経系はどうか?

人間の神経系は 周囲で起きている あらゆることを伝えてくれます しかし我々の作る物の神経系は ごく原始的なものです 例えば 車が街中の交差点で 道路に開いた穴を踏んでも 自分で市道路局に 連絡することはありません 建物は 中に入った人たちが 気に入ってくれているか 設計家に伝えることはありません おもちゃメーカーは おもちゃが実際に遊ばれているか どこでどう使われているか 楽しまれているかどうか 知りません バービー人形のデザイナーは 自分の人形に このようなライフスタイルを 想像していたことでしょう

(笑)

でも本当はバービーが すごく孤独だったとしたら?

(笑)

自分のデザインしたものについて 実際にどんなことが起きているか デザイナーに分かれば 道路にせよ 建物にせよ バービーにせよ その知識を生かして 利用者にとって より良い体験を 生み出すことができるでしょう 欠けているのは 我々がデザインし 作り 使うもの すべてと我々を繋ぐ神経系です 世に出した自分の作品から そのような情報が 流れてくるとしたらどうでしょう? 自分の作ったものを 人々が買ってくれるよう 説得するために 我々は膨大な お金と労力を費やしています 昨年は2兆ドルという 規模でした もしデザインし 作ったものに対し 世に出した後 販売された後 公開された後に そのような繋がりを持てたなら ビジネスのやり方も変わるでしょう 作った商品を人々が欲しくなるよう 仕向けるのでなく 人々がそもそも欲しいと 思うものを作るのです

良い知らせは デザインしたものと繋がる デジタル神経系に 我々は既に取り組んでいる ということです あるプロジェクトで私たちは ロサンゼルスの バンディート・ブラザーズに属する 2人と組んで 作業しています 彼らのやっていることの1つは とんでもないことをする とんでもない車を作るということです ほんとうにクレージーな連中です ―

(笑)

いい意味で 我々がやっているのは 従来のレーシングカーの車体に 神経系を組み込むということです

何十というセンサーを取り付け 世界第一級のドライバーに 運転してもらい 砂漠を1週間 狂ったように走り回るのです 車の神経系が 車に起きたことを すべて捕らえます データポイントの数は 40億にもなります 車が受けたあらゆる力を 記録しています それからクレージーなことをしました そうやって得たデータを Dreamcatcherという デザイン生成AIに入力します デザインツールに神経系を与えて 究極の車体を作れと言ったら 何ができるのでしょう? こんなものが得られます これは人間には決して デザインできないようなものです デザイン生成AIと デジタル神経系で 拡張された人間によって デザインされたもので ロボットで実際に 製造することができます

そういう「拡張の時代」が 我々の未来であり 人間が知的・肉体的・認知的に 拡張されるのだとしたら いったい どんなことになるのか? そのおとぎの国は どんな風になるのでしょう?

来る世界では 物は製造されるより 栽培されるようになるでしょう 建築されるよりは 育てられるようになるでしょう 孤立したものから 繋がったものへと 採掘から 集積へと変わるでしょう 服従を求めるより 自律を尊ぶようになるでしょう

拡張された能力によって 世界は劇的に 変わるでしょう 世界はもっと多様で 繋がっていて ダイナミックで 複雑で 適応的で そしてもちろん ― より美しいものになります 未来に現れるものの姿は 見たこともないものに なるでしょう なぜなら それらを形作るのは テクノロジーと 自然と 人間による 新しい共同関係だからです それは楽しみに待つ価値のある 未来に思えます

ありがとうございました

(拍手)

品詞分類

- 主語

- 動詞

- 助動詞

- 準動詞

- 関係詞等

TED 日本語

TED Talks

関連動画

10分で分かる量子コンピュータショヒーニ・ゴーシュ

2019.02.01

あなたの人生にサウンドトラックを付けてくれるAIピエール・バロー

2018.10.01

実在の人物の偽映像の作り方と、その見分け方スパソーン・スワジャナコーン

おすすめ 12018.07.25

AIはいかに人の記憶、仕事、社会生活を改善するかトム・グルーバー

2017.08.21

コンピューターはいかに物体を即座に認識できるようになったのかジョセフ・レドモン

2017.08.18

知性を持つ機械を恐れるな、協働せよガルリ・カスパロフ

2017.06.20

人工知能が人間を超えるのを怖れることはないグラディ・ブーチ

2017.03.13

表計算ソフト誕生の話ダン・ブリックリン

2017.02.01

機械知能は人間の道徳性をより重要なものにするゼイナップ・トゥフェックチー

2016.11.11

コンピューターはこうしてクリエイティブになるブレイス・アグエラ・ヤルカス

2016.07.22

Linuxの背後にある精神リーナス・トーバルズ

2016.05.03

ホログラム時代の未来にあるものアレックス・キップマン

2016.04.18

拡張現実ヘッドセットを通して未来を覗くメロン・グリベッツ

2016.04.11

形状変化テクノロジーが仕事を革新するショーン・フォルマー

2016.03.01

インターネットをスクリーンなしで見るとトム・アグロ―

2015.11.13

顔を見るだけで感情がわかるアプリラナ・エル・カリウビ

2015.06.15

洋楽 おすすめ

RECOMMENDS

洋楽歌詞

ステイザ・キッド・ラロイ、ジャスティン・ビーバー

洋楽最新ヒット2021.08.20

スピーチレス~心の声ナオミ・スコット

洋楽最新ヒット2019.05.23

シェイプ・オブ・ユーエド・シーラン

洋楽人気動画2017.01.30

フェイデッドアラン・ウォーカー

洋楽人気動画2015.12.03

ウェイティング・フォー・ラヴアヴィーチー

洋楽人気動画2015.06.26

シー・ユー・アゲインウィズ・カリファ

洋楽人気動画2015.04.06

シュガーマルーン5

洋楽人気動画2015.01.14

シェイク・イット・オフテイラー・スウィフト

ポップス2014.08.18

オール・アバウト・ザット・ベースメーガン・トレイナー

ポップス2014.06.11

ストーリー・オブ・マイ・ライフワン・ダイレクション

洋楽人気動画2013.11.03

コール・ミー・メイビーカーリー・レイ・ジェプセン

洋楽人気動画2012.03.01

美しき生命コールドプレイ

洋楽人気動画2008.08.04

バッド・デイ~ついてない日の応援歌ダニエル・パウター

洋楽人気動画2008.05.14

サウザンド・マイルズヴァネッサ・カールトン

洋楽人気動画2008.02.19

イッツ・マイ・ライフボン・ジョヴィ

ロック2007.10.11

アイ・ウォント・イット・ザット・ウェイバックストリート・ボーイズ

洋楽人気動画2007.09.14

マイ・ハート・ウィル・ゴー・オンセリーヌ・ディオン

洋楽人気動画2007.07.12

ヒーローマライア・キャリー

洋楽人気動画2007.03.21

オールウェイズ・ラヴ・ユーホイットニー・ヒューストン

洋楽人気動画2007.02.19

オネスティビリー・ジョエル

洋楽人気動画2005.09.16