TED日本語

TED Talks(英語 日本語字幕付き動画)

TED日本語 - ラナ・エル・カリウビ: 顔を見るだけで感情がわかるアプリ

TED Talks

顔を見るだけで感情がわかるアプリ

This app knows how you feel -- from the look on your face

ラナ・エル・カリウビ

Rana el Kaliouby

内容

感情は私たちの生活のあらゆる面に影響します ― 学び方やコミュニケーションの取り方、決定の仕方まで様々です。しかし、デジタルにおいてはそれが欠けています。私たちが用いる電子機器やアプリは、私たちの感情を知りようがないのです。科学者のラナ・エル・カリウビは、これを変えようとしています。彼女は顔の表情を読み取って、それに対応する感情と結びつける、強力な新しいテクノロジーを実演します。この「感情エンジン」には大きな意味があり、私たちが機械と関わる方法だけでなく、お互いに交流する方法をも変える可能性がある、と彼女は言います。

字幕

SCRIPT

Script

Our emotions influence every aspect of our lives, from our health and how we learn, to how we do business and make decisions, big ones and small. Our emotions also influence how we connect with one another. We've evolved to live in a world like this, but instead, we're living more and more of our lives like this -- this is the text message from my daughter last night -- in a world that's devoid of emotion. So I'm on a mission to change that. I want to bring emotions back into our digital experiences.

I started on this path 15 years ago. I was a computer scientist in Egypt, and I had just gotten accepted to a Ph.D. program at Cambridge University. So I did something quite unusual for a young newlywed Muslim Egyptian wife: With the support of my husband, who had to stay in Egypt, I packed my bags and I moved to England. At Cambridge, thousands of miles away from home, I realized I was spending more hours with my laptop than I did with any other human. Yet despite this intimacy, my laptop had absolutely no idea how I was feeling. It had no idea if I was happy, having a bad day, or stressed, confused, and so that got frustrating. Even worse, as I communicated online with my family back home, I felt that all my emotions disappeared in cyberspace. I was homesick, I was lonely, and on some days I was actually crying, but all I had to communicate these emotions was this. (Laughter) Today's technology has lots of I.Q., but no E.Q.; lots of cognitive intelligence, but no emotional intelligence. So that got me thinking, what if our technology could sense our emotions? What if our devices could sense how we felt and reacted accordingly, just the way an emotionally intelligent friend would? Those questions led me and my team to create technologies that can read and respond to our emotions, and our starting point was the human face.

So our human face happens to be one of the most powerful channels that we all use to communicate social and emotional states, everything from enjoyment, surprise, empathy and curiosity. In emotion science, we call each facial muscle movement an action unit. So for example, action unit 12, it's not a Hollywood blockbuster, it is actually a lip corner pull, which is the main component of a smile. Try it everybody. Let's get some smiles going on. Another example is action unit 4. It's the brow furrow. It's when you draw your eyebrows together and you create all these textures and wrinkles. We don't like them, but it's a strong indicator of a negative emotion. So we have about 45 of these action units, and they combine to express hundreds of emotions.

Teaching a computer to read these facial emotions is hard, because these action units, they can be fast, they're subtle, and they combine in many different ways. So take, for example, the smile and the smirk. They look somewhat similar, but they mean very different things. (Laughter) So the smile is positive, a smirk is often negative. Sometimes a smirk can make you become famous. But seriously, it's important for a computer to be able to tell the difference between the two expressions.

So how do we do that? We give our algorithms tens of thousands of examples of people we know to be smiling, from different ethnicities, ages, genders, and we do the same for smirks. And then, using deep learning, the algorithm looks for all these textures and wrinkles and shape changes on our face, and basically learns that all smiles have common characteristics, all smirks have subtly different characteristics. And the next time it sees a new face, it essentially learns that this face has the same characteristics of a smile, and it says, "Aha, I recognize this. This is a smile expression."

So the best way to demonstrate how this technology works is to try a live demo, so I need a volunteer, preferably somebody with a face. (Laughter) Cloe's going to be our volunteer today.

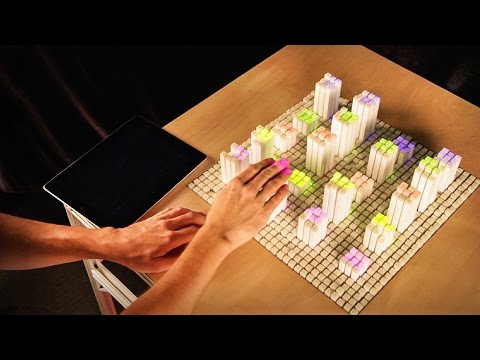

So over the past five years, we've moved from being a research project at MIT to a company, where my team has worked really hard to make this technology work, as we like to say, in the wild. And we've also shrunk it so that the core emotion engine works on any mobile device with a camera, like this iPad. So let's give this a try.

As you can see, the algorithm has essentially found Cloe's face, so it's this white bounding box, and it's tracking the main feature points on her face, so her eyebrows, her eyes, her mouth and her nose. The question is, can it recognize her expression? So we're going to test the machine. So first of all, give me your poker face. Yep, awesome. (Laughter) And then as she smiles, this is a genuine smile, it's great. So you can see the green bar go up as she smiles. Now that was a big smile. Can you try a subtle smile to see if the computer can recognize? It does recognize subtle smiles as well. We've worked really hard to make that happen. And then eyebrow raised, indicator of surprise. Brow furrow, which is an indicator of confusion. Frown. Yes, perfect. So these are all the different action units. There's many more of them. This is just a slimmed-down demo. But we call each reading an emotion data point, and then they can fire together to portray different emotions. So on the right side of the demo -- look like you're happy. So that's joy. Joy fires up. And then give me a disgust face. Try to remember what it was like when Zayn left One Direction. (Laughter) Yeah, wrinkle your nose. Awesome. And the valence is actually quite negative, so you must have been a big fan. So valence is how positive or negative an experience is, and engagement is how expressive she is as well. So imagine if Cloe had access to this real-time emotion stream, and she could share it with anybody she wanted to. Thank you. (Applause)

So, so far, we have amassed 12 billion of these emotion data points. It's the largest emotion database in the world. We've collected it from 2.9 million face videos, people who have agreed to share their emotions with us, and from 75 countries around the world. It's growing every day. It blows my mind away that we can now quantify something as personal as our emotions, and we can do it at this scale.

So what have we learned to date? Gender. Our data confirms something that you might suspect. Women are more expressive than men. Not only do they smile more, their smiles last longer, and we can now really quantify what it is that men and women respond to differently. Let's do culture: So in the United States, women are 40 percent more expressive than men, but curiously, we don't see any difference in the U.K. between men and women. (Laughter) Age: People who are 50 years and older are 25 percent more emotive than younger people. Women in their 20s smile a lot more than men the same age, perhaps a necessity for dating. But perhaps what surprised us the most about this data is that we happen to be expressive all the time, even when we are sitting in front of our devices alone, and it's not just when we're watching cat videos on Facebook. We are expressive when we're emailing, texting, shopping online, or even doing our taxes.

Where is this data used today? In understanding how we engage with media, so understanding virality and voting behavior; and also empowering or emotion-enabling technology, and I want to share some examples that are especially close to my heart. Emotion-enabled wearable glasses can help individuals who are visually impaired read the faces of others, and it can help individuals on the autism spectrum interpret emotion, something that they really struggle with. In education, imagine if your learning apps sense that you're confused and slow down, or that you're bored, so it's sped up, just like a great teacher would in a classroom. What if your wristwatch tracked your mood, or your car sensed that you're tired, or perhaps your fridge knows that you're stressed, so it auto-locks to prevent you from binge eating. (Laughter) I would like that, yeah. What if, when I was in Cambridge, I had access to my real-time emotion stream, and I could share that with my family back home in a very natural way, just like I would've if we were all in the same room together?

I think five years down the line, all our devices are going to have an emotion chip, and we won't remember what it was like when we couldn't just frown at our device and our device would say, "Hmm, you didn't like that, did you?" Our biggest challenge is that there are so many applications of this technology, my team and I realize that we can't build them all ourselves, so we've made this technology available so that other developers can get building and get creative. We recognize that there are potential risks and potential for abuse, but personally, having spent many years doing this, I believe that the benefits to humanity from having emotionally intelligent technology far outweigh the potential for misuse. And I invite you all to be part of the conversation. The more people who know about this technology, the more we can all have a voice in how it's being used. So as more and more of our lives become digital, we are fighting a losing battle trying to curb our usage of devices in order to reclaim our emotions. So what I'm trying to do instead is to bring emotions into our technology and make our technologies more responsive. So I want those devices that have separated us to bring us back together. And by humanizing technology, we have this golden opportunity to reimagine how we connect with machines, and therefore, how we, as human beings, connect with one another.

Thank you.

(Applause)

私たちの感情は 生活のあらゆる面に影響します 健康や学び方 ビジネスのやり方や決定の仕方まで 大小様々です 感情は私たちがお互いと 結びつく方法にも影響します 今まで私たちは このような世界に順応してきましたが 現在の世界は どんどん このようになってきています これは昨晩 娘から届いた 携帯メールです 感情のない世界ですね 私はそれを変えるべく活動しています デジタルでの体験に 感情を取り戻したいのです

この道を歩み始めたのは15年前 ― エジプトでコンピューターサイエンスを 学んでいたときのことです ケンブリッジ大学の博士課程に 合格したところでした 私が取った行動は 結婚したての若いイスラム教徒の エジプト人妻としてはかなり珍しいものでした エジプトに残らねばならない 夫のサポートを得て 私は荷物をまとめて イングランドにやってきたのです 故郷から何千キロも離れた ケンブリッジで 私は自分が他の人と過ごすよりも 長い時間を ノートパソコンと過ごしていることに 気づきました とても近しいものでありながら ノートパソコンに私の感情は分かりません 私が嬉しかろうと ストレスを抱えて混乱し 嫌な1日を過ごそうと伝わらないので 歯がゆい気持ちになりました さらに悪いことに オンラインで 家族と会話をしていても 感情がすべてサイバー空間に 消えてしまうような気がしました ホームシックで寂しい思いをし 泣いたときもありましたが 感情を表す手段はこれだけでした (笑) 現在のテクノロジーには IQはあってもEQはありません 知能指数は高くても 心の知能指数はないのです そこで私は考えました テクノロジーが感情を 感じ取れるとしたらどうだろう? 心の知能指数を持った友人のように 電子機器が感情を読み取って それに応じて反応したらどうだろう? これらの問いによって 私とチームは 感情を読み取り 対応できる テクノロジーを開発するに至り 私たちの出発点は人間の顔でした

人間の顔は 社会的・感情的状態を伝えるのに 誰もが用いている 非常に強力な手段のひとつです 喜びや驚き ― 共感や好奇心まで様々あります 感情科学では顔面筋肉の動き それぞれをアクション・ユニットと言います 例えば アクション・ユニット12は ハリウッド映画のタイトルではありませんよ これは口の端を引く動きで 笑顔の主な要素です 試してみて下さい 笑顔になりますね もうひとつの例はアクション・ユニット4で これは眉をひそめる動きです 両眉をひそめると 凹凸やしわができますね 好まれるものではありませんが 否定的な感情を強く示すサインです こうしたアクション・ユニットが45個あり これらが組み合わさって 何百もの感情を表します

こうした顔の表情をコンピューターに 読み取らせるのは困難です アクション・ユニットは動きが素早く 加減が微妙ですし 様々に組み合わせられるためです 例えば 笑顔と ぎこちない作り笑いです どこかしら似てはいますが 意味合いは随分違います (笑) 笑顔はポジティブで わざと作った笑顔は ネガティブなことが多いです 作り笑いで有名になることもあります ですが真面目な話 コンピューターが 2つの表情の違いを 読み取れることが重要です

では どうすればいいでしょう? 私達の開発したアルゴリズムに 純粋な笑顔を見せている人々の例を 何万例も与えます 人種 年齢 性別も様々です そして作り笑いにも 同様のことを行います するとディープラーニング(深層学習)で アルゴリズムが 顔面に起こる凹凸やしわや 形状の変化を探し 笑顔には共通の特徴があり 作り笑いには微妙に異なる 特徴があることを学習します 以降は 未知の顔に遭遇しても 基本的に この顔が 笑顔の特徴を 備えていることを認識し 「あぁわかった これは笑顔ですね」 と言うのです

このテクノロジーの働きを お見せする一番の方法は ここで実演することです 誰か手伝ってもらえませんか 顔がある人がいいのですが (笑) クロイに手伝ってもらいましょう

ここ5年間で私たちはMITでの 研究プロジェクトから 企業へと変化しました 私のチームはこのテクノロジーが いわば「外の世界で」 機能するよう努力してきました またコンパクトにすることで 感情エンジンの核となる部分が iPadのようなカメラ付き携帯機器で 使えるようにしました では やってみましょう

ご覧のように アルゴリズムが クロイの顔を認識しました 白い四角で示されており 顔の主な部分を追跡しています 眉、目、口や鼻などです さあ 表情を読み取れるでしょうか? 機械を試してみましょう まず ポーカーフェイスを見せて下さい いいですね (笑) それから笑顔です これは心からの笑顔ですね 彼女が笑うと 緑色のバーが上がるのが分かります 満面の笑みでしたね コンピューターが認識できるか 微笑みを作ってみましょう 微笑みでも認識できますね これには大変苦労しました 眉が上がると 驚きの表情のサインです 眉をひそめると 困惑を示すサインです 眉をひそめて 完璧です これらは全て異なるアクション・ユニットで まだ他にも多くありますが ほんの一部だけお見せしました それぞれの感情のデータポイントを 読み取らせることができ それらが合わさって 様々な感情を表現することができます デモの右側には ― 喜びの表情を見せて これが喜びですね 「喜び」の項目が上がりました それから 嫌悪の表情を見せて下さい ゼインがワン・ダイレクションを 脱退したのを思い出して (笑) 鼻にもしわが寄ります いいですね 感情価がかなりネガティブでしたから 熱心なファンだったのでしょう 「感情価」は経験がいかにポジティブ またはネガティブであったか そして「関与度」は いかに強く表現したかです クロイがこのリアルタイムでの 感情ストリームを利用でき それを他の人と共有できると 想像してみて下さい どうもありがとう (拍手)

これまでに120億の 感情データポイントを収集しました 世界最大の感情データベースです 290万の顔の写ったビデオから 集めましたが 感情を共有することに 同意した人たち ― 世界75か国から集まりました これは日々 増えています 感情というごく個人的なものを 今やこれほどの規模で 数量化できるなんて 私の想像を超えています

では 今日までにわかったことは 何でしょうか? ジェンダーです 皆さんが薄々気づいていることを データが立証しました 女性の方が男性より表情豊かです より頻繁に笑顔になるだけでなく 笑顔が持続します 今や男性と女性が 異なる反応を見せるものについて 数量化することができます 文化の違いではどうでしょう アメリカでは ― 女性は男性より40%表情豊かですが 面白いことにイギリスでは 男女の差異はありません (笑) 年齢です 50歳以上の人々は 若者よりも25%さらに感情的です 20代の女性は同じ年代の男性よりも ずっと頻繁に笑顔になり これはデートで 必要となるのかもしれません このデータで最も驚かされるのは いかに私たちが常に 表情豊かであるかと言うことです 電子機器の前に 独りで座っているときでもです Facebookで猫のビデオを 見ているときだけではありません メールや携帯メールを書くときや オンラインショッピング ― 確定申告の準備中でも 表情豊かなのです

このデータは今 どこで使われているのでしょう? メディアとの関わり方の研究 ― つまりバイラリティーや 投票行動などの理解や また 能力を高めたり 感情を利用するテクノロジーにも使えます 私が特に大切に思う例を お話ししたいと思います 感情を理解する 眼鏡型端末があれば 視覚障害者が 他者の表情を読むのに役立ちます 自閉症のスペクトラムの人が 非常に苦労している ― 感情の理解にも役立ちます 教育においては学習アプリが 生徒の困惑や退屈の表情に気付き 教室で熟練の教師がするように 学習のペースを 調整することができるでしょう 腕時計があなたの気分をモニターしたり 車があなたの疲労度合いを 感知できたら ― あるいは冷蔵庫が ストレスを感知して ばか食いを防ぐために 自動ロックしたらどうでしょうか (笑) 私は良いと思いますね 私がケンブリッジにいた頃 リアルタイムの 感情ストリームを利用して 故郷にいる家族と感情を ごく自然に ― まるで同じ部屋にいるように 共有できたらどうだったでしょう?

今から5年もすれば 電子機器はすべて 感情チップを搭載し 電子機器に向かって 眉をひそめれば 「気に入らなかったんだね」と 言ってくれなかった昔のことなど 忘れてしまうでしょう 最大の難関はこのテクノロジーには 非常に多くの使い道があり 私たちのチームだけでは 全てを開発できないと気づいたことです そこで このテクノロジーを利用可能にして 他の開発者たちが 独自に開発を進められるようにしました 私たちはリスクの可能性も 認識しています 濫用されるリスクです でも個人的には 何年も携わってきて 心の知能指数の高い テクノロジーによって 人類にもたらされる利益の方が 濫用のリスクよりも ずっと多いと考えています 皆さんにも対話に参加をお願いします このテクノロジーを 知っている人が多ければ多いほど 使用法に関する意見を 多く得ることができます 私たちの生活が さらにデジタルなものになるにつれ 私たちは感情を再び手にするために 電子機器の使用を控えようという 負けが明らかな闘いに挑んでいます その代わりに 私が試みているのは テクノロジーに感情を導入すること そしてテクノロジーが 反応するものにすることです 私たちを引き離した電子機器によって 再び人々を 結びつけようとしているのです テクノロジーに人間性を付与することで 私たちには 機械との関わりを見つめ直す 絶好の機会が与えられています つまり人間として 私たちが いかにお互いとつながり合うかを 見つめ直す機会なのです

ありがとうございました

(拍手)

品詞分類

- 主語

- 動詞

- 助動詞

- 準動詞

- 関係詞等

TED 日本語

TED Talks

関連動画

10分で分かる量子コンピュータショヒーニ・ゴーシュ

2019.02.01

あなたの人生にサウンドトラックを付けてくれるAIピエール・バロー

2018.10.01

実在の人物の偽映像の作り方と、その見分け方スパソーン・スワジャナコーン

おすすめ 12018.07.25

AIはいかに人の記憶、仕事、社会生活を改善するかトム・グルーバー

2017.08.21

コンピューターはいかに物体を即座に認識できるようになったのかジョセフ・レドモン

2017.08.18

知性を持つ機械を恐れるな、協働せよガルリ・カスパロフ

2017.06.20

人工知能が人間を超えるのを怖れることはないグラディ・ブーチ

2017.03.13

直感を持った人工知能が生み出すすごい発明モーリス・コンティ

2017.02.28

表計算ソフト誕生の話ダン・ブリックリン

2017.02.01

機械知能は人間の道徳性をより重要なものにするゼイナップ・トゥフェックチー

2016.11.11

コンピューターはこうしてクリエイティブになるブレイス・アグエラ・ヤルカス

2016.07.22

Linuxの背後にある精神リーナス・トーバルズ

2016.05.03

ホログラム時代の未来にあるものアレックス・キップマン

2016.04.18

拡張現実ヘッドセットを通して未来を覗くメロン・グリベッツ

2016.04.11

形状変化テクノロジーが仕事を革新するショーン・フォルマー

2016.03.01

インターネットをスクリーンなしで見るとトム・アグロ―

2015.11.13

洋楽 おすすめ

RECOMMENDS

洋楽歌詞

ステイザ・キッド・ラロイ、ジャスティン・ビーバー

洋楽最新ヒット2021.08.20

スピーチレス~心の声ナオミ・スコット

洋楽最新ヒット2019.05.23

シェイプ・オブ・ユーエド・シーラン

洋楽人気動画2017.01.30

フェイデッドアラン・ウォーカー

洋楽人気動画2015.12.03

ウェイティング・フォー・ラヴアヴィーチー

洋楽人気動画2015.06.26

シー・ユー・アゲインウィズ・カリファ

洋楽人気動画2015.04.06

シュガーマルーン5

洋楽人気動画2015.01.14

シェイク・イット・オフテイラー・スウィフト

ポップス2014.08.18

オール・アバウト・ザット・ベースメーガン・トレイナー

ポップス2014.06.11

ストーリー・オブ・マイ・ライフワン・ダイレクション

洋楽人気動画2013.11.03

コール・ミー・メイビーカーリー・レイ・ジェプセン

洋楽人気動画2012.03.01

美しき生命コールドプレイ

洋楽人気動画2008.08.04

バッド・デイ~ついてない日の応援歌ダニエル・パウター

洋楽人気動画2008.05.14

サウザンド・マイルズヴァネッサ・カールトン

洋楽人気動画2008.02.19

イッツ・マイ・ライフボン・ジョヴィ

ロック2007.10.11

アイ・ウォント・イット・ザット・ウェイバックストリート・ボーイズ

洋楽人気動画2007.09.14

マイ・ハート・ウィル・ゴー・オンセリーヌ・ディオン

洋楽人気動画2007.07.12

ヒーローマライア・キャリー

洋楽人気動画2007.03.21

オールウェイズ・ラヴ・ユーホイットニー・ヒューストン

洋楽人気動画2007.02.19

オネスティビリー・ジョエル

洋楽人気動画2005.09.16