TED日本語

TED Talks(英語 日本語字幕付き動画)

TED日本語 - プラナフ・ミストリー: 次なる可能性を秘めたSixthSenseテクノロジー

TED Talks

次なる可能性を秘めたSixthSenseテクノロジー

The thrilling potential of SixthSense technology

プラナフ・ミストリー

Pranav Mistry

内容

TEDIndiaでプラナフ・ミストリーが、SixthSenseデバイスの詳細をはじめ、パラダイムシフトを起こす新しい紙のノートPCなど、日常生活とデータの世界の交流を可能にするツールの数々を見せてくれます。ステージ上でのQ&Aでは、SixthSenseの可能性をすべての人が手にできるよう、ソフトウェアをオープンソースにする予定であると語っています。

字幕

SCRIPT

Script

We grew up interacting with the physical objects around us. There are an enormous number of them that we use every day. Unlike most of our computing devices, these objects are much more fun to use. When you talk about objects,one other thing automatically comes attached to that thing, and that is gestures: how we manipulate these objects, how we use these objects in everyday life. We use gestures not only to interact with these objects, but we also use them to interact with each other. A gesture of "Namaste!", maybe, to respect someone, or maybe -- in India I don't need to teach a kid that this means "four runs" in cricket. It comes as a part of our everyday learning.

So, I am very interested, from the beginning, that how -- how our knowledge about everyday objects and gestures, and how we use these objects, can be leveraged to our interactions with the digital world. Rather than using a keyboard and mouse, why can I not use my computer in the same way that I interact in the physical world?

So, I started this exploration around eight years back, and it literally started with a mouse on my desk. Rather than using it for my computer, I actually opened it. Most of you might be aware that, in those days, the mouse used to come with a ball inside, and there were two rollers that actually guide the computer where the ball is moving, and, accordingly, where the mouse is moving. So, I was interested in these two rollers, and I actually wanted more, so I borrowed another mouse from a friend -- never returned to him -- and I now had four rollers. Interestingly, what I did with these rollers is, basically, I took them off of these mouses and then put them in one line. It had some strings and pulleys and some springs. What I got is basically a gesture interface device that actually acts as a motion-sensing device made for two dollars. So, here, whatever movement I do in my physical world is actually replicated inside the digital world just using this small device that I made, around eight years back, in 2000.

Because I was interested in integrating these two worlds, I thought of sticky notes. I thought, "Why can I not connect the normal interface of a physical sticky note to the digital world?" A message written on a sticky note to my mom on paper can come to an SMS, or maybe a meeting reminder automatically syncs with my digital calendar -- a to-do list that automatically syncs with you. But you can also search in the digital world, or maybe you can write a query, saying, "What is Dr. Smith's address?" and this small system actually prints it out -- so it actually acts like a paper input-output system, just made out of paper.

In another exploration, I thought of making a pen that can draw in three dimensions. So, I implemented this pen that can help designers and architects not only think in three dimensions, but they can actually draw so that it's more intuitive to use that way.

Then I thought, "Why not make a Google Map, but in the physical world?" Rather than typing a keyword to find something, I put my objects on top of it. If I put a boarding pass, it will show me where the flight gate is. A coffee cup will show where you can find more coffee, or where you can trash the cup.

So, these were some of the earlier explorations I did because the goal was to connect these two worlds seamlessly. Among all these experiments, there was one thing in common: I was trying to bring a part of the physical world to the digital world. I was taking some part of the objects, or any of the intuitiveness of real life, and bringing them to the digital world, because the goal was to make our computing interfaces more intuitive.

But then I realized that we humans are not actually interested in computing. What we are interested in is information. We want to know about things. We want to know about dynamic things going around.

So I thought, around last year -- in the beginning of the last year -- I started thinking, "Why can I not take this approach in the reverse way?" Maybe, "How about I take my digital world and paint the physical world with that digital information?" Because pixels are actually, right now, confined in these rectangular devices that fit in our pockets. Why can I not remove this confine and take that to my everyday objects, everyday life so that I don't need to learn the new language for interacting with those pixels?

So, in order to realize this dream, I actually thought of putting a big-size projector on my head. I think that's why this is called a head-mounted projector, isn't it? I took it very literally, and took my bike helmet, put a little cut over there so that the projector actually fits nicely. So now, what I can do -- I can augment the world around me with this digital information.

But later, I realized that I actually wanted to interact with those digital pixels, also. So I put a small camera over there, that acts as a digital eye. Later, we moved to a much better, consumer-oriented pendant version of that, that many of you now know as the SixthSense device.

But the most interesting thing about this particular technology is that you can carry your digital world with you wherever you go. You can start using any surface, any wall around you, as an interface. The camera is actually tracking all your gestures. Whatever you're doing with your hands, it's understanding that gesture. And, actually, if you see, there are some color markers that in the beginning version we are using with it. You can start painting on any wall. You stop by a wall, and start painting on that wall. But we are not only tracking one finger, here. We are giving you the freedom of using all of both of your hands, so you can actually use both of your hands to zoom into or zoom out of a map just by pinching all present. The camera is actually doing -- just, getting all the images -- is doing the edge recognition and also the color recognition and so many other small algorithms are going on inside. So, technically, it's a little bit complex, but it gives you an output which is more intuitive to use, in some sense.

But I'm more excited that you can actually take it outside. Rather than getting your camera out of your pocket, you can just do the gesture of taking a photo and it takes a photo for you.

(Applause)

Thank you.

And later I can find a wall, anywhere, and start browsing those photos or maybe, "OK, I want to modify this photo a little bit and send it as an email to a friend." So, we are looking for an era where computing will actually merge with the physical world. And, of course, if you don't have any surface, you can start using your palm for simple operations. Here, I'm dialing a phone number just using my hand. The camera is actually not only understanding your hand movements, but, interestingly, is also able to understand what objects you are holding in your hand.

What we're doing here is actually -- for example, in this case, the book cover is matched with so many thousands, or maybe millions of books online, and checking out which book it is. Once it has that information, it finds out more reviews about that, or maybe New York Times has a sound overview on that, so you can actually hear, on a physical book, a review as sound. ("famous talk at Harvard University ...")

This was Obama's visit last week to MIT. ("... and particularly I want to thank two outstanding MIT ...") So, I was seeing the live [ video ] of his talk, outside, on just a newspaper. Your newspaper will show you live weather information rather than having it updated -- like, you have to check your computer in order to do that, right?

(Applause)

When I'm going back, I can just use my boarding pass to check how much my flight has been delayed, because at that particular time, I'm not feeling like opening my iPhone, and checking out a particular icon. And I think this technology will not only change the way -- yes. (Laughter) It will change the way we interact with people, also, not only the physical world. The fun part is, I'm going to the Boston metro, and playing a pong game inside the train on the ground, right? (Laughter) And I think the imagination is the only limit of what you can think of when this kind of technology merges with real life.

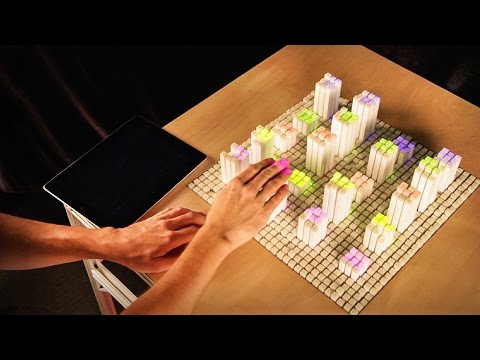

But many of you argue, actually, that all of our work is not only about physical objects. We actually do lots of accounting and paper editing and all those kinds of things; what about that? And many of you are excited about the next generation tablet computers to come out in the market. So, rather than waiting for that, I actually made my own, just using a piece of paper. So, what I did here is remove the camera -- All the webcam cameras have a microphone inside the camera. I removed the microphone from that, and then just pinched that -- like I just made a clip out of the microphone -- and clipped that to a piece of paper, any paper that you found around. So now the sound of the touch is getting me when exactly I'm touching the paper. But the camera is actually tracking where my fingers are moving.

You can of course watch movies. ("Good afternoon. My name is Russell ... and I am a Wilderness Explorer in Tribe 54.")

And you can of course play games. (Car engine) Here, the camera is actually understanding how you're holding the paper and playing a car-racing game. (Applause)

Many of you already must have thought, OK, you can browse. Yeah. Of course you can browse to any websites or you can do all sorts of computing on a piece of paper wherever you need it. So, more interestingly, I'm interested in how we can take that in a more dynamic way. When I come back to my desk I can just pinch that information back to my desktop so I can use my full-size computer.

(Applause)

And why only computers? We can just play with papers. Paper world is interesting to play with. Here, I'm taking a part of a document and putting over here a second part from a second place -- and I'm actually modifying the information that I have over there. Yeah. And I say, "OK, this looks nice, let me print it out, that thing." So I now have a print-out of that thing, and now -- the workflow is more intuitive the way we used to do it maybe 20 years back, rather than now switching between these two worlds.

So, as a last thought, I think that integrating information to everyday objects will not only help us to get rid of the digital divide, the gap between these two worlds, but will also help us, in some way, to stay human, to be more connected to our physical world. And it will actually help us not end up being machines sitting in front of other machines.

That's all. Thank you.

(Applause)

Thank you.

(Applause)

Chris Anderson: So, Pranav, first of all, you're a genius. This is incredible, really. What are you doing with this? Is there a company being planned? Or is this research forever, or what?

Pranav Mistry: So, there are lots of companies -- actually sponsor companies of Media Lab -- interested in taking this ahead in one or another way. Companies like mobile phone operators want to take this in a different way than the NGOs in India, [ who ] are thinking, "Why can we only have 'Sixth Sense'? We should have a 'Fifth Sense' for missing-sense people who can not speak. This technology can be used for them to speak out in a different way with maybe a speaker system."

CA: What are your own plans? Are you staying at MIT, or are you going to do something with this?

PM: I'm trying to make this more available to people so that anyone can develop their own SixthSense device, because the hardware is actually not that hard to manufacture or hard to make your own. We will provide all the open source software for them, maybe starting next month.

(Applause)

CA: Are you going to come back to India with some of this, at some point?

PM: Yeah. Yes, yes, of course.

CA: What are your plans? MIT? India? How are you going to split your time going forward?

PM: There is a lot of energy here. Lots of learning. All of this work that you have seen is all about my learning in India. And now, if you see, it's more about the cost-effectiveness: this system costs you $ 300 compared to the $ 20,000 surface tables, or anything like that. Or maybe even the $ 2 mouse gesture system at that time was costing around $ 5,000? So, we actually -- I showed that, at a conference, to President Abdul Kalam, at that time, and then he said, "OK, we should use this in Bhabha Atomic Research Centre for some use of that." So I'm excited about how I can bring the technology to the masses rather than just keeping that technology in the lab environment.

(Applause)

CA: Based on the people we've seen at TED, I would say you're truly one of the two or three best inventors in the world right now. It's an honor to have you at TED. Thank you so much. That's fantastic.

(Applause)

私たちは 身の回りのモノに触れて育ってきました 私たちが日常生活で使うモノは ものすごく沢山あります コンピュータ機器の多くとは違い 日常生活のモノというのは 使うのが楽しいものです 日常生活のモノについて話題にするとき それに付随してくるものがもう1つあります ジェスチャーです それらのモノをどうやって扱うのか 実生活でそれらのモノをどう使うのか ジェスチャーはモノに対してだけ使うわけではありません 人に対しても使います 「ナマステ!」のジェスチャーは 誰かに敬意を示すときにします インドの子供なら これはクリケットの「4ラン」だと 教えられなくとも知っています 生活の中で自然に学び取るのです

私は早い時期に 興味を持った事があります 「モノやジェスチャーに対する 私たちの知識や 実生活でモノをどう使うかということが デジタル世界をより良くするために役立てられないだろうか?」 キーボードやマウスを使うかわりに 日常的なジェスチャーで コンピュータを使うことはできないだろうか?

8年ほど前に私はこの探求を始めました そして自分の机の上にあるマウスをまず手に取りました それでコンピュータを使うというのではなく 中を開けてみたのです マウスというのは 昔は中にボールが入っていました 2つのローラーが マウスを動かしたときのボールの動きを コンピュータに伝えるようになっています だから私はこの2つのローラーに興味を持ち もっと欲しくなって友達からもマウスを借りました 返すことはありませんでしたが これでローラーが4つになりました そのローラーを使って何をやったかというと マウスから取り外して 一列に並べ 紐と滑車とバネをつけたのです 出来上がったのは ジェスチャーをインターフェイスとする装置で モーションセンサの働きをします 2ドルでできました 私が実世界でした動きが この小さな装置を通して デジタル世界で再現されます 2000年のことです

2つの世界の統合に私は関心があって 次に考えたのは付箋メモです 普段使っている付箋メモを 電子的な付箋メモへの インタフェースにできないだろうか? 紙に書いたお母さん宛の メッセージが SMSとして届き 予定のメモが 自動的にデジタルの予定表と同期し TODOリストも自動的に同期するという具合に そうすると デジタル世界の中で検索することもでき 「スミス先生の住所は?」 といった問い合わせもできます 結果は紙に印刷されて出てきます これは入出力を紙でするシステムで 紙だけが外に見えています

別な探求として 私は3次元に書けるペンというのも考えました そのペンがあれば デザイナや建築家が 3次元で考えるというだけでなく 実際に3次元で書くこともでき ずっと直感的に使えるはずです

Google Mapsを日常生活の中に 引っ張り出せないか? とも思いました 何かを探すために検索語を打ち込むのではなく モノをその上に載せるのです 搭乗チケットを載せれば ゲートへの道順を示してくれ コーヒーカップを置けば コーヒーを買える場所や ゴミ箱の場所を示すという具合です

どれも私が初期にやった探求です 私の目的はずっと2つの世界を継ぎ目なく結ぶということでした これらの実験にはどれも 1つの共通点があります 身の回りの世界の一部をデジタル世界に持ってこようとしていることです モノの一部や 実生活の直感的な面を デジタル世界に持ち込んでいます コンピュータをもっと直感的に使えるようにしたかったのです

しかし私たちが興味を持っているのは コンピュータ自体ではないということに気がつきました 私たちに関心があるのは コンピュータの中にある情報です 私たちは物事について知りたいと思います どんなことが起こっているのかを知りたいと思います

それで去年の初めくらいから考えるようになりました 「このアプローチを逆にすることはできないだろうか?」 デジタル世界を取り出して 日常生活の中に投影してみたらどうだろう? ピクセルデータは このポケットに入る四角い装置の中に 収められています 日常生活の世界へ それを解き放てるなら ピクセルをいじるために 新しい言語を覚える必要もなくなるのでは?

この夢を実現しようと 私は大きなプロジェクタを実際頭に載せてみました ヘッドマウントプロジェクタというわけです バイクのヘルメットに 切り込みを入れて プロジェクタがうまく載るようにしました そうやって デジタル情報で 身の回りの現実を拡張できるようになりました

しかし後になって 私はそのデジタル情報も操作したいと思うようになりました それでデジタルの目として 小さなカメラを付けました その後 もっと改良して コンシューマ向けのペンダント型を作りました それがご存じのSixthSenseデバイスです

このテクノロジーが特に興味深いのは 自分の行くところはどこへでもデジタル世界を 持っていくことができるという点です どこか壁を見つけ それを操作面として 使うことができます カメラがジェスチャーを捉え 様々な身振りを 解釈します 初期のバージョンでは ご覧のような カラーマーカーを使っていました どこの壁でもかまいません 壁の前で立ち止まって投影します 追跡するのは一本の指だけではありません 両手の指がすべて使えます だから地図を両手でつまんで 拡大 縮小ができます カメラで実際にやっているのは エッジ認識や 色彩認識そのほか沢山の 細かいアルゴリズムによる処理です 技術的には結構複雑なのですが 結果としては直感的に使えるものになっています

これの楽しいところは 外に持ち出せるということです カメラをポケットから取り出すことなく ただ写真を撮るジェスチャーをするだけで 写真を撮してくれます

(拍手)

どうも

写真を撮ったら どこでも壁を見つけて 写真を映して見ることができます 「よし この写真にちょっと手を入れて 友達にメールで送ってやろう」 私たちはコンピュータの世界と日常の世界が 混じり合う時代を迎えようとしているのです 適当な壁がないときには 自分の手のひらの上で簡単な操作をすることもできます 手のひらでダイヤルしているところです カメラは手の動きを認識するだけでなく さらには 手に持っているモノを認識することもできます

たとえばここでやっているのは 手に取った本の表紙を 何千何万という オンラインの情報と照合し どの本かを調べています どれかわかったら その本のレビューを表示したり ニューヨークタイムズのサイトにある 音声による解説を引っ張ってきて 実際の本を手にしながら聞くことができます (…ハーバード大学で行われた有名な講演で…)

これはオバマ大統領が先週MITを訪れたときのものです (…特にMITの2人の傑出した教授にお礼を言いたい…) 私は彼の講演のライブビデオを 外で新聞の上で見ているわけです あるいはコンピュータを使わずに 新聞でライブの天気情報を 見ることができます

(拍手)

私が帰るときには 搭乗チケットで 飛行機の遅れを 確認できます iPhoneを取り出して アイコンを叩くまでもありません この技術は… ええ (笑) モノばかりでなく 人との関わり方も 変えます お遊びとして ボストンの地下鉄に乗って 電車の床で卓球ゲームを することだって出来ます (笑) このようなテクノロジーが生活に溶け込むとき できることを制限するものは 自らの想像力だけです

私たちが扱うのは 日常生活のモノばかりではないと言う人もいるでしょう 実際 会計とか編集とか いろんなことをします そしてあなた方の多くは 次世代のタブレットPCが市場に登場するのを 心待ちにしていることでしょう 私はそれをただ待っているのではなく 自分のを紙切れを使って作ることにしました 私がやったのは Webカメラにはマイクが入っているのですが それを取り出して クリップにして 紙に付けられるようにしました どんな紙でも使えます そうすると紙にタッチしたときに タッチ音が出るようにできます 実際の指の動きはカメラが把握します

もちろん映画だって見ることができます (こんにちは 僕はラッセル 荒野探検隊 第54隊の隊員です)

それにゲームも (エンジン音) ここでは紙をどう持っているかをカメラが把握して レーシングゲームを操作しています (拍手)

見ることができることについては お分りいただけたと思います Webサイトやコンピュータ画面を 紙切れの上で見ることができます どこにいようと もっと面白いのは これをもっと生きたものにするということです 自分の部屋に戻ったとき 情報をつまんで パソコンの上に落としてやれば 続きを大きなパソコンでやることができます

(拍手)

コンピュータだけではありません 紙にもできます 紙の世界で遊ぶのはとても面白いです 資料の一部をこちらに取って 別なところからも何か取ってきて 情報をその場で 修正できます 「よし いい感じにできたぞ 印刷しよう」 そうして印刷します このような 20年くらい前に やっていたやり方のほうが 2つの世界の間で行き来する現在のやり方より直感的です

最後になりますが 身の回りのモノに情報を統合することで これら2つの世界の溝を埋め デジタルデバイドをなくせるだけでなく もっと身の回りの世界と繋がり もっと人間らしく 生きられるようになると思います そして私たちは機械の一部みたいに ならずにいられるでしょう

以上です

(スタンディングオベーション)

どうもありがとうございます

(拍手)

プラナフ はっきり言って 君は天才だよ 本当にすごいよ これをどうするつもり? 会社を作る予定はあるの? それともずっと研究を続けていくの?

実際メディアラボのスポンサーの中には この技術を どう発展させるかに関心を持つ企業がたくさんあります たとえば携帯電話会社は インドのNGOとは違ったことを求めています 「どうして'Sixth Sense' (第六感)しかないの? 障害者のための'Fifth Sense'(第五感)が あってしかるべきだ この技術を使えば 彼らが別な仕方で 話せるようにできる」

君自身の計画は? MITにずっといるの? これで何かするの?

これをより多くの人が利用できるようにして 誰でもSixthSenseデバイスを開発できるようにしたいと思っています これのハードウェアを作るのは そんなに難しくはありません このソフトウェアはオープンソースにする予定です たぶん来月あたりから公開します

そいつはすごい ワオ

(喝采)

いつかインドに戻ってこようと思っているの?

ええ もちろん

どういう計画? MITとインドで 時間をどう切り分けるつもり?

ここには多くのエネルギーがあり 学びがあります ご覧いただいたものは 私がインドで学んだことを元にしています そしてコスト効率に目を向けるなら このシステムは300ドルです テーブル型PCみたいなものは2万ドルもします あるいはあの2ドルで作ったマウスジェスチャーシステムは 同じようなものが 当時は5千ドルくらいしました あるカンファレンスで座長の アブドゥル カラムに見せたら こう言ってくれました「バーバー原子力研究センターでも ぜひこれを使わなきゃ」 私はテクノロジーを研究室に閉じ込めておくのではなく たくさんの人に届けるということにワクワクします

(拍手)

TEDで会った人の意見を聞くと 君は現在の世界で 最高の発明家の1人だと思う 君をTEDに迎えられてとても光栄に思います どうもありがとう 実に素晴らしい

(スタンディングオベーション)

品詞分類

- 主語

- 動詞

- 助動詞

- 準動詞

- 関係詞等

TED 日本語

TED Talks

関連動画

10分で分かる量子コンピュータショヒーニ・ゴーシュ

2019.02.01

あなたの人生にサウンドトラックを付けてくれるAIピエール・バロー

2018.10.01

実在の人物の偽映像の作り方と、その見分け方スパソーン・スワジャナコーン

おすすめ 12018.07.25

AIはいかに人の記憶、仕事、社会生活を改善するかトム・グルーバー

2017.08.21

コンピューターはいかに物体を即座に認識できるようになったのかジョセフ・レドモン

2017.08.18

知性を持つ機械を恐れるな、協働せよガルリ・カスパロフ

2017.06.20

人工知能が人間を超えるのを怖れることはないグラディ・ブーチ

2017.03.13

直感を持った人工知能が生み出すすごい発明モーリス・コンティ

2017.02.28

表計算ソフト誕生の話ダン・ブリックリン

2017.02.01

機械知能は人間の道徳性をより重要なものにするゼイナップ・トゥフェックチー

2016.11.11

コンピューターはこうしてクリエイティブになるブレイス・アグエラ・ヤルカス

2016.07.22

Linuxの背後にある精神リーナス・トーバルズ

2016.05.03

ホログラム時代の未来にあるものアレックス・キップマン

2016.04.18

拡張現実ヘッドセットを通して未来を覗くメロン・グリベッツ

2016.04.11

形状変化テクノロジーが仕事を革新するショーン・フォルマー

2016.03.01

インターネットをスクリーンなしで見るとトム・アグロ―

2015.11.13

洋楽 おすすめ

RECOMMENDS

洋楽歌詞

ステイザ・キッド・ラロイ、ジャスティン・ビーバー

洋楽最新ヒット2021.08.20

スピーチレス~心の声ナオミ・スコット

洋楽最新ヒット2019.05.23

シェイプ・オブ・ユーエド・シーラン

洋楽人気動画2017.01.30

フェイデッドアラン・ウォーカー

洋楽人気動画2015.12.03

ウェイティング・フォー・ラヴアヴィーチー

洋楽人気動画2015.06.26

シー・ユー・アゲインウィズ・カリファ

洋楽人気動画2015.04.06

シュガーマルーン5

洋楽人気動画2015.01.14

シェイク・イット・オフテイラー・スウィフト

ポップス2014.08.18

オール・アバウト・ザット・ベースメーガン・トレイナー

ポップス2014.06.11

ストーリー・オブ・マイ・ライフワン・ダイレクション

洋楽人気動画2013.11.03

コール・ミー・メイビーカーリー・レイ・ジェプセン

洋楽人気動画2012.03.01

美しき生命コールドプレイ

洋楽人気動画2008.08.04

バッド・デイ~ついてない日の応援歌ダニエル・パウター

洋楽人気動画2008.05.14

サウザンド・マイルズヴァネッサ・カールトン

洋楽人気動画2008.02.19

イッツ・マイ・ライフボン・ジョヴィ

ロック2007.10.11

アイ・ウォント・イット・ザット・ウェイバックストリート・ボーイズ

洋楽人気動画2007.09.14

マイ・ハート・ウィル・ゴー・オンセリーヌ・ディオン

洋楽人気動画2007.07.12

ヒーローマライア・キャリー

洋楽人気動画2007.03.21

オールウェイズ・ラヴ・ユーホイットニー・ヒューストン

洋楽人気動画2007.02.19

オネスティビリー・ジョエル

洋楽人気動画2005.09.16